人工知能とハイパフォーマンス・コンピューティングが急速に発展している今日、メモリ帯域幅は計算能力を制限する重要なボトルネックとなっています。GPUの計算能力をスーパーファクトリーの組立ラインと想像してみてください。一方、従来のメモリは狭い「原材料供給パイプ」を提供するだけで、高価な計算リソースはアイドリング状態でデータを待つだけです。これが、今日のAIトレーニングが直面している核心的な課題である。HBM4(High Bandwidth Memory 4)は、このボトルネックをきっぱりと打ち砕き、AI主導のコンピュート爆発に不可欠なストレージ・バックボーンを提供します。.

HBM4とは?

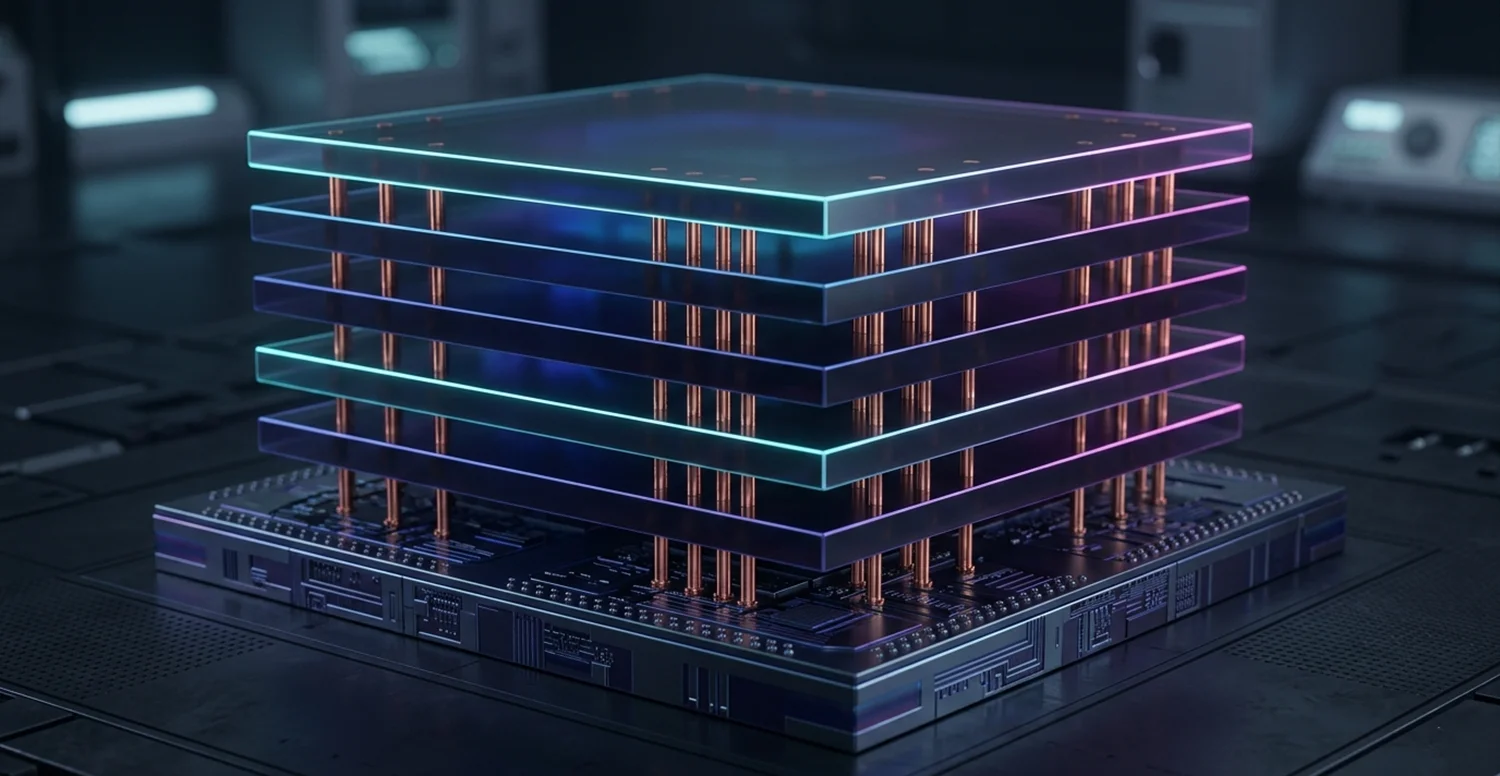

高帯域幅メモリー は、メモリ帯域幅を拡大することで計算能力を開放し、「メモリの壁」問題を解決するために誕生しました。従来のメモリとはまったく異なる設計思想を採用しており、複数のDRAMチップを垂直方向に積層し、TSV(Through-Silicon Via)技術を使って高速に相互接続することで、極めて小さな物理的フットプリントで大容量のデータ転送幅を実現している。2013年の第1世代HBMから今日まで、このファミリーは10年以上にわたって進化しており、HBM4はその最新のマイルストーンです。.

HBM4は、第6世代の広帯域メモリ技術である。 JESD270-4規格 2025年4月にJEDECによって発表された。HBM3/HBM3Eの後継として、AIトレーニング、ハイパフォーマンス・コンピューティング、ハイエンド・データセンターGPU向けに特化されている。HBMファミリーの3Dスタックド・アーキテクチャーを継承し、複数のDRAMチップを垂直に積み重ね、ロジック・ベース・ダイと統合することで、極めて高い帯域幅密度とコンパクトなパッケージングを実現し、業界ではAIコンピュート向けの「スーパー穀倉」と呼ばれています。.

HBM4は何がそれほど強力なのか?

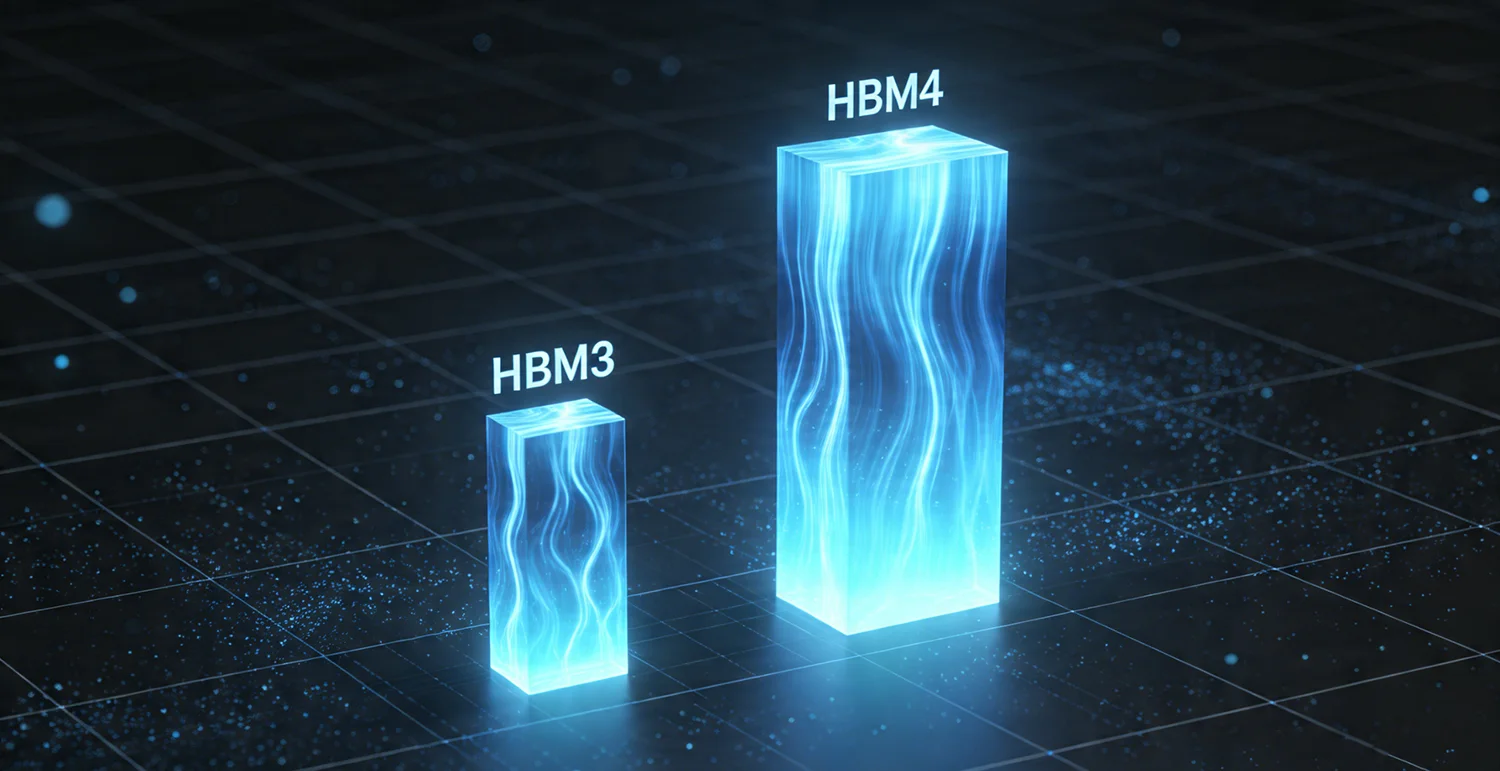

前世代のHBM3Eと比較して、HBM4は包括的な性能の飛躍を実現します。以下の表は、主な変更点を簡単に示したものです:

| 仕様 | HBM3 | HBM4 | 改善 |

|---|---|---|---|

| インターフェース幅 | 1024ビット | 2048ビット | 倍 |

| 標準帯域幅 | ~819GB/秒 | 2TB/s | ~2.4× |

| 独立チャンネル | 16 | 32 | 倍 |

| スタックあたりの最大容量 | 24GB(8ハイ) | 64GB(16ハイ) | ~2.7× |

| 動作電圧 | 固定 ~1.1V | VDDQ 0.7~0.9V、VDDC 1.0~1.05V | より柔軟に、より効率的に |

では、この数字が本当に意味するものを分解してみよう。.

より広いインターフェイス、より高い帯域幅

HBM4では、スタックあたりのデータ・インターフェイスが1024ビットから2048ビットに倍増しました。これは何を意味するのか。現在最も先進的なDDR5メモリのシングル・チャンネル・インターフェース幅はわずか64ビットです。つまり、1つのHBM4スタックは、32個のDDR5チャネルが同時に動作するのと同等の帯域幅を持つことになります。インターフェイス幅が2倍になれば、同じデータレートでも総帯域幅は自動的に2倍になります。また、実際のベンダー製品はより高速で動作することが多いため、最終的な帯域幅は簡単に2TB/秒を超え、3TB/秒を超えることさえあります。.

より多くのチャンネル、より柔軟なデータスケジューリング

チャンネル数は16から32に増え、各チャンネルには2つの疑似チャンネルが含まれる。チャンネルはメモリ内部の独立した「レーン」と考えることができ、チャンネル数が多いほど、システムは互いに干渉することなく、より多くのメモリアクセス要求を同時に発行できることになる。これは、AIコンピューティングにおける超並列行列演算に特に適しており、アクセス競合を大幅に減らし、実効帯域幅を向上させる。.

モデル全体を収納できる大容量

DRAMスタック層を最大8層から16層に増やすことで、1つのHBM4メモリスタックは最大64GBに達する。実際の製品では、AIアクセラレータは通常4~8個のHBMスタックを統合しているため、総メモリ容量は256GB、あるいは512GBを容易に超えることになる。兆パラメータ規模の大規模モデルの場合、このような容量により、モデル・パラメータと中間結果を完全に高速メモリに常駐させることができるため、低速のVRAMやシステム・メモリからの頻繁な転送が不要になります。.

低電圧、優れたエネルギー効率

HBM4は、より洗練された電圧管理を導入しています。I/O電圧VDDQは0.7Vから0.9Vの間で調整でき、コア電圧VDDCは1.0Vから1.05Vの間で選択できる。低い電圧は消費電力を直接的に削減する。ベンダーのデータによると、HBM4のビット転送あたりのエネルギーは、HBM3Eより約40%低い。大規模データセンターにとって、これは電気代の削減と冷却需要の減少を意味します。.

新しいセキュリティ機能DRFM

HBM4には、重要な信頼性機能であるDRFM(Directed Refresh Management)も追加されています。これは、隣接するメモリ行を繰り返し高速に読み書きすることにより、隣接する行のビット反転を引き起こすセキュリティ脆弱性である「ロウ・ハマー」攻撃を効果的に防御します。DRFMは、これらの行をインテリジェントに識別し、選択的にリフレッシュすることで、メモリのセキュリティとデータの整合性を大幅に強化します。.

HBM4における主な技術的ブレークスルーとは?

ハイブリッド・ボンディング

ハイブリッド・ボンディングは、メモリ・パッケージングにおける次の画期的なソリューションとして注目されている。従来のマイクロバンプ技術は、ミクロン単位の金属バンプを使ってチップを接続するもので、そのピッチは約10μm。ハイブリッド・ボンディングはこうしたバンプを完全に排除し、2 つのチップの銅表面を原子レベルで平らできれいな状態に整え、次にそれらを直接接触させることで、銅原子が拡散し、温度と圧力の下で融合します。.

サムスンが発表したテストデータによると、ハイブリッドボンディングはチップ間相互接続ピッチを10μm以下に縮小し、相互接続密度を数倍から数十倍に高めると同時に、より低い抵抗、より短い信号経路、より優れた放熱性を実現できる。サムスンの実測データによると、バンプレス・ハイブリッド・ボンディングはHBMスタックの高さを3分の1増加させ、熱抵抗を20%減少させることができる。しかし、ハイブリッド・ボンディング装置はコストが高く(従来のボンダーの約2倍)、量産歩留まりはまだ改善する必要があるため、この技術は現在の量産HBM4製品にはまだ適用されていない。サムスンは、ハイブリッド・ボンディングに基づく16-Hi HBMサンプルを顧客に出荷しており、HBM4E(HBM4の強化版)から徐々に商業的採用が始まると予想される。.

分散インターフェースと疑似チャンネル・アーキテクチャ

HBM4は、HBM3の2倍となる32の完全に独立したチャンネルを持つ設計を採用しており、各チャンネルは2つの擬似チャンネルを備え、32のDQモードをサポートしています。この分散アーキテクチャの利点は、すべてのチャネルが同期的に動作する必要がないことです。各チャネルは独立してデータ要求を処理できるため、並列アクセス効率が劇的に向上します。これは特にテンソル演算やAIモデル学習における不規則なデータアクセスパターンに適している。.

従来のメモリのシングルチャンネルデザインと比較すると、HBM4のマルチチャンネルアーキテクチャは、単一車線の高速道路を32の独立した複数車線の高速道路に拡張するようなものです。.

ワイドインターフェース、低消費電力設計

HBM4は、電力密度を低く保ちながら極めて高い帯域幅を達成するために、「超広帯域インターフェイス+比較的低いクロック周波数」という戦略を採用しています。従来のメモリは、クロック周波数を上げることで帯域幅を増加させることが多く、これは消費電力の急激な増加につながります。HBM4はその逆で、2048ビット幅のデータバスにより、比較的控えめな周波数で従来型メモリの数倍の帯域幅を実現します。この設計により、HBM4のビットあたりのエネルギーは30~40%削減され、AIのコスト削減と効率向上のトレンドにおいて大きな利点となります。.

さらに、HBM4はベンダー固有のVDDQ電圧最適化(0.7Vから0.9Vの間で調整可能)をサポートし、エネルギー効率をさらに向上させます。これにより、大規模なデータセンター展開において、総消費電力を効果的に制御し、運用コストを削減することができます。同時に、HBM4はHBM3コントローラとの下位互換性を維持しており、1つのコントローラで両方のメモリ世代をサポートできるため、システムアップグレードの障壁が低くなります。.

HBM4 3巨人の進捗状況とロードマップ

サムスンが世界で初めてHBM4の量産を発表。サムスン電子は2026年2月12日、4nmのロジックダイと12-Hi積層技術を使用し、JEDECの標準規格である8Gbpsと2TB/秒をはるかに上回る11.7Gbpsのデータレートと3.3TB/秒の帯域幅を実現するHBM4の世界初の商業的量産を開始し、顧客出荷を開始したと発表した。サムスンは2026年後半にHBM4Eのサンプルを導入し、さらなる性能向上を図るとともに、スタックあたりの容量を48GBに拡大する16-Hiスタック・バージョンを開発し、次世代AIアクセラレータへの道を開く計画だ。.

SKハイニックスはHBM4分野で急速な進歩を遂げている。同社の技術ロードマップによると、2026年に容量48GB、統一インターフェース幅を2048ビットにアップグレードした16-HiスタックドHBM4製品を発売する計画だ。同社はハイブリッド・ボンディングなどの次世代パッケージング技術に積極的に投資しているが、これまでに同社がデモした16-Hiサンプルは、依然として成熟したMR-MUF技術を使用している。SK Hynixは、NVIDIAやAMDなどの主要顧客と緊密に協力しながら、2026年に量産を開始する予定である。.

マイクロン・テクノロジーは、HBM4メモリが2026年第1四半期に量産を開始し、初期出荷は2.8TB/秒以上のメモリ帯域幅を実現する36GBの12-Hiバージョンであることを確認した。この製品は、エヌビディアのVera Rubinプラットフォーム向けに構築され、次世代のデータセンターAIトレーニングをサポートする。この「オンデマンド・カスタマイズ」戦略は、マイクロンを特定の顧客セグメントにおいて有利に位置づけるものである。.

HBM4はAIと高性能コンピューティングをどう強化するか?

次世代AIアクセラレーターの推進

HBM4は次世代データセンターGPUの標準メモリとなった。主要なAIチップベンダー(NVIDIA、AMD、Intel)はいずれも、最新のアクセラレーター・プラットフォームでHBM4を採用している。例えば、NVIDIAのVera Rubinプラットフォームでは、8つのHBM4スタックを搭載することで、理論的なメモリ帯域幅は22 TB/秒に達する可能性があり、288 GBのメモリ容量から、1兆パラメータ規模の大規模モデルのトレーニングに十分なスペースとデータチャネルを提供することができる。AMDの次世代インスティンクトMI400シリーズも、堅牢なHBM4構成を計画している。MI455Xモデルは、12個のHBM4スタック、合計432GBの容量、19.6TB/秒の帯域幅を備え、メモリと帯域幅を必要とする大規模なAIトレーニングと推論タスクをターゲットとする。さらに、インテルの次世代AIアクセラレーター「Jaguar Shores」もHBM4テクノロジーを採用する。具体的な帯域幅と容量の数値は明らかにされていないが、HBM4エコシステムへの参加は明確な方向性である。.

メモリ制約のない大規模モデル学習を可能にする

生成的なAIトレーニング、特に数千億から数兆のパラメータを持つ大規模な言語モデルは、HBM4の中核となるアプリケーションシナリオです。これらのモデルは、膨大なパラメータ・セットとデータの同時処理を必要とするため、メモリ帯域幅と容量に極めて厳しい要件を課します。HBM4が提供するアクセラレータ・カード1枚あたり288~384GBのメモリは、従来は複数のカードを併用する必要があった大規模なモデル・パラメータや長いコンテキスト・ウィンドウを、1枚のカードで保持できることを意味します。これにより、トレーニング中にカード間でデータを頻繁に分割する必要がなくなり、通信オーバーヘッドやモデルのシャーディングによる効率低下を回避できるため、トレーニングサイクルが大幅に短縮されます。実際のAIサービス展開において、HBM4は大規模モデルの推論性能を69%以上向上させることができます。.

科学研究とシミュレーションの加速

ハイパフォーマンス・コンピューティングにおいて、HBM4は膨大なデータスループットを必要とする科学的コンピューティングに不可欠なインフラを提供します。天気予報であれ、量子コンピュータ・シミュレーションであれ、ゲノム配列解析であれ、すべてが高帯域幅、大容量のメモリ・システムに依存しています。天気予報を例にとると、世界中の気象観測所、人工衛星、レーダーが膨大な量のリアルタイムデータを刻々と生成しています。HBM4はこれらのデータストリームを高速に処理できるため、スーパーコンピュータはより詳細な大気モデルの計算を短時間で完了できるようになり、異常気象予測の精度と早期警報のスピードが向上します。ゲノム配列決定では、HBM4は何百万もの遺伝子配列を同時に比較・解析できるため、病気に関連する遺伝子や創薬ターゲットの特定が加速し、新薬開発の貴重な時間を節約することができます。.

ハイエンドグラフィックスとプロフェッショナルなビジュアライゼーションの拡大

現在のコンシューマー向けグラフィックスカードは主にGDDRメモリーを使用していますが、HBMシリーズはその超高帯域幅と低消費電力により、プロフェッショナル向けグラフィックスワークステーションやトップクラスのゲーミングカードの潜在的な選択肢として常に注目されてきました。HBM4の量産コストが徐々に低下するにつれて、一般ユーザーはいつの日か、8Kゲーム、リアルタイムレンダリング、ビデオ編集などのシナリオで、よりスムーズで効率的なコンテンツ制作体験を享受できるようになるかもしれない。超高解像度ビデオや複雑な3Dモデリングを扱うプロフェッショナルにとって、HBM4はレンダリングの待ち時間を大幅に短縮し、クリエイティブなプロセスをより流動的で自然なものにするでしょう。.

第6世代の高帯域幅メモリ技術であるHBM4は、2048ビットの超広帯域インターフェイス、32チャネル・アーキテクチャ、ハイブリッド・ボンディング技術により、帯域幅と容量の二重の飛躍を実現します。メモリの壁」のボトルネックを打破する重要なメモリ・ソリューションです。AIトレーニング、ハイパフォーマンス・コンピューティング、ハイエンド・データセンターGPUに強力なストレージ・サポートを提供するだけでなく、メモリ技術がハイブリッド・ボンディングと3Dスタッキングの時代に突入する新時代の幕開けでもあります。HBM4の大規模な商用化とその技術の継続的な成熟により、AIコンピュートパワーが新たな飛躍を遂げ、より多くの最先端技術とアプリケーションシナリオを解き放ち、人類社会の発展に多大な変化をもたらすと確信しています。.