在当今飞速发展的人工智能和高性能计算时代,内存带宽已成为限制计算能力的关键瓶颈--业界通常称之为 “内存墙 ”问题。将 GPU 的计算能力想象成一条超级工厂流水线,而传统内存只能提供狭窄的 “原材料供应管道”,导致昂贵的计算资源闲置并等待数据。这就是当今人工智能训练面临的核心挑战。HBM4(高带宽内存 4)将彻底打破这一瓶颈,为人工智能驱动的计算爆炸提供重要的存储骨干。.

什么是 HBM4?

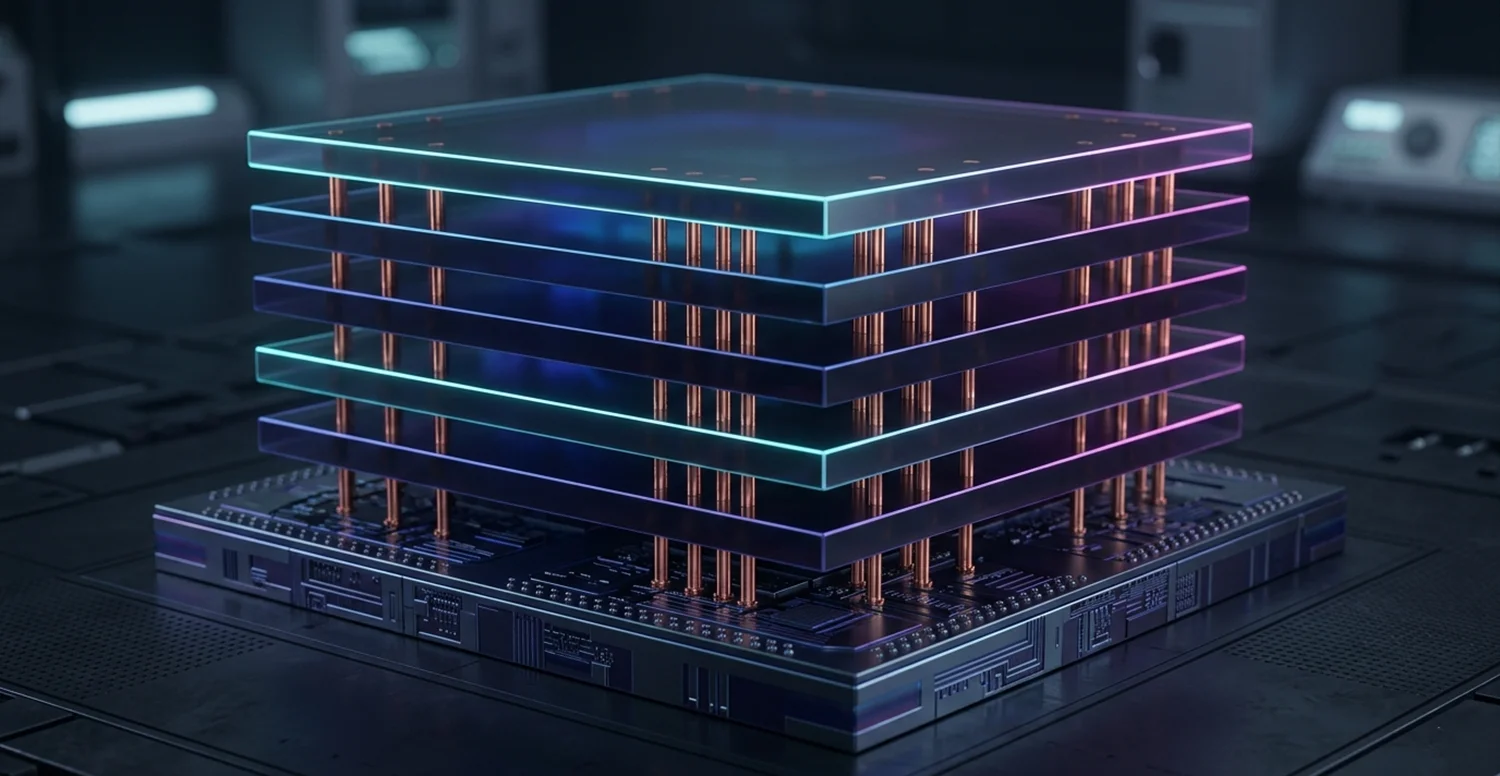

高带宽内存 的诞生就是为了解决 “内存墙 ”问题,通过提高内存带宽来释放计算能力。它采用了与传统内存完全不同的设计理念--垂直堆叠多个 DRAM 芯片,并使用硅通孔(TSV)技术将它们高速互连,从而在极小的物理空间内实现了巨大的数据传输宽度。从 2013 年的第一代 HBM 到今天,这个系列已经发展了十多年,而 HBM4 是其最新的里程碑。.

HBM4 是第六代高带宽内存技术,正式发布为 JESD270-4 标准 由 JEDEC 于 2025 年 4 月推出。作为 HBM3/HBM3E 的后继产品,它专为人工智能培训、高性能计算和高端数据中心 GPU 而设计。它延续了 HBM 系列的三维堆叠架构,将多个 DRAM 芯片垂直堆叠,并与逻辑基础芯片集成,实现了极高的带宽密度和紧凑的封装,因此被业界誉为人工智能计算的 “超级粮仓”。.

是什么让 HBM4 如此强大?

与上一代 HBM3E 相比,HBM4 实现了全面的性能飞跃。下表让您快速了解核心变化:

| 规格 | HBM3 | HBM4 | 改进 |

|---|---|---|---|

| 接口宽度 | 1024 位 | 2048 位 | 加倍 |

| 标准带宽 | ~819 GB/s | 2 TB/s | ~2.4× |

| 独立频道 | 16 | 32 | 加倍 |

| 每堆最大容量 | 24 GB(8-高) | 64 GB(16-高) | ~2.7× |

| 工作电压 | 固定 ~1.1V | VDDQ 0.7-0.9V, VDDC 1.0-1.05V | 更灵活、更高效 |

现在,让我们来分析一下这些数字的真正含义。.

更宽的界面、更高的带宽

HBM4 将每个堆栈的数据接口从 1024 位加倍到 2048 位。这意味着什么?目前最先进的 DDR5 内存的单通道接口宽度仅为 64 位。这意味着一个 HBM4 堆栈的带宽相当于 32 个 DDR5 通道同时工作。接口宽度增加一倍后,即使数据速率相同,总带宽也会自动增加一倍。而实际供应商的产品通常以更高的速度运行,因此最终带宽可以轻松超过 2 TB/s,甚至超过 3 TB/s。.

渠道更多,数据调度更灵活

通道数量从 16 个增加到 32 个,每个通道包括两个伪通道。通道可视为内存内部的独立 “通道”--通道越多,意味着系统可以同时发出更多内存访问请求,而不会相互干扰。这对人工智能计算中的大规模并行矩阵操作尤为有利,可显著减少访问争用,提高有效带宽。.

容量更大,可容纳整个模型

通过将 DRAM 堆栈层数从最多 8 层增加到 16 层,单个 HBM4 内存堆栈的容量最高可达 64 GB。在实际产品中,人工智能加速器通常集成 4 到 8 个 HBM 堆栈,这意味着总内存容量可以轻松超过 256 GB 甚至 512 GB。对于万亿个参数的大型模型而言,这样的容量可以让模型参数和中间结果完全驻留在高速内存中,而无需频繁地从较慢的 VRAM 或系统内存中传输。.

电压更低,能效更高

HBM4 引入了更精细的电压管理。I/O 电压 VDDQ 可在 0.7V 和 0.9V 之间调节,核心电压 VDDC 可在 1.0V 和 1.05V 之间选择。较低的电压可直接降低功耗。根据供应商提供的数据,HBM4 的每比特传输能耗比 HBM3E 低约 40%。对于大型数据中心来说,这意味着更低的电费和更少的冷却需求。.

新的安全功能:DRFM

HBM4 还增加了一项重要的可靠性功能--定向刷新管理 (DRFM)。它能有效抵御 “行锤 ”攻击,这是一种安全漏洞,即反复快速读写相邻内存行会导致相邻行的位翻转。DRFM 可智能识别并有选择地刷新这些行,从而大大增强了内存安全性和数据完整性。.

HBM4 有哪些关键技术突破?

混合粘接

混合键合被视为存储器封装领域的下一个革命性解决方案。传统的微凸块技术使用微米级的金属凸块连接芯片,间距约为 10 微米,这种物理限制阻碍了更高密度的堆叠和更快的信号传输。混合键合技术完全消除了这些凸点,将两个芯片的铜表面处理成原子级的平整和清洁,然后使它们直接接触,从而使铜原子在温度和压力下扩散和融合。.

根据三星公布的测试数据,混合键合可以将芯片到芯片的互连间距缩小到 10μm 以下,将互连密度提高几倍到几十倍,同时提供更低的电阻、更短的信号路径和更好的散热。三星的测量数据显示,无缓冲混合键合可将 HBM 堆叠高度提高三分之一,热阻降低 20%。然而,由于混合键合设备成本高昂(约为传统键合设备的两倍),量产良率仍有待提高,因此该技术尚未应用于当前批量生产的 HBM4 产品。三星已经向客户交付了基于混合键合技术的 16-Hi HBM 样品,预计将从 HBM4E(HBM4 的增强版)开始逐步商业化应用。.

分布式接口和伪通道架构

HBM4 采用 32 个完全独立通道的设计,是 HBM3 的两倍,每个通道配备 2 个伪通道,支持 32 种 DQ 模式。这种分布式架构的优势在于它不要求所有通道同步运行。每个通道可以独立处理数据请求,极大地提高了并行访问效率。这尤其适合人工智能模型训练中的张量操作和不规则数据访问模式。.

与传统内存的单通道设计相比,HBM4 的多通道架构就像将一条单线高速公路扩展为 32 条独立的多线高速公路,每条高速公路都能同时高效地传输数据--彻底消除了数据交通堵塞,使 GPU 能够更充分地利用其计算能力。.

宽接口、低功耗设计

HBM4 采用 “超宽接口+相对较低的时钟频率 ”策略,在保持低功率密度的同时实现了极高的带宽。传统内存通常通过提高时钟频率来增加带宽,但这会导致功耗急剧增加。而 HBM4 则恰恰相反:通过 2048 位宽数据总线,它能以相对较低的频率提供数倍于传统内存的带宽。这种设计将 HBM4 的每比特能耗降低了 30-40%,在降低人工智能成本和提高效率的趋势中具有显著优势。.

此外,HBM4 还支持针对特定供应商的 VDDQ 电压优化(可在 0.7V 至 0.9V 之间调节),进一步提高了能效。这使得大规模数据中心部署能够有效控制总功耗,降低运营成本。同时,HBM4 保持了与 HBM3 控制器的向后兼容性--单个控制器即可支持两代内存,从而降低了系统升级的门槛。.

HBM4 的进展和三大巨头的路线图

三星是全球首家宣布量产 HBM4 的制造商。三星电子于 2026 年 2 月 12 日宣布,已开始在全球范围内首次商业化量产 HBM4,并开始向客户出货。HBM4 采用 4nm 逻辑芯片和 12-Hi 堆叠技术,可提供 11.7 Gbps 的数据传输率和 3.3 TB/s 的带宽,远远超过 JEDEC 的 8 Gbps 和 2 TB/s 标准。三星计划在 2026 年下半年推出 HBM4E 样品,以进一步提高性能,同时还将开发 16-Hi 堆叠版本,将每堆叠容量扩展到 48 GB,为下一代人工智能加速器铺平道路。.

SK Hynix 在 HBM4 领域进展迅速。根据其技术路线图,该公司计划在 2026 年推出 16-Hi 堆叠 HBM4 产品,容量为 48 GB,接口宽度统一升级到 2048 位。虽然该公司正在积极投资于下一代封装技术,如混合键合技术,但迄今为止展示的 16-Hi 样品仍使用其成熟的 MR-MUF 技术。SK Hynix 计划与英伟达(NVIDIA)和 AMD 等主要客户密切合作,在 2026 年实现量产。.

美光科技(Micron Technology)证实,其 HBM4 内存已于 2026 年第一季度进入量产,首批出货量为 36 GB 12-Hi 版本,内存带宽超过 2.8 TB/s。该产品将专为英伟达公司的 Vera Rubin 平台打造,以支持下一代数据中心人工智能培训。这种 “按需定制 ”战略使美光在特定客户群中占据有利地位。.

HBM4 如何助力人工智能和高性能计算?

推动下一代人工智能加速器的发展

HBM4 已成为下一代数据中心 GPU 的标准内存。主要的人工智能芯片供应商--英伟达、AMD、英特尔--都在其最新的加速器平台上采用了 HBM4。例如,在英伟达的 Vera Rubin 平台上,使用 8 个 HBM4 堆栈,理论内存带宽可达 22 TB/s,起始内存容量为 288 GB,可为万亿参数的大型模型训练提供充足的空间和数据通道。AMD 的下一代 Instinct MI400 系列也计划采用强大的 HBM4 配置:MI455X 型号将配备 12 个 HBM4 堆栈,总容量为 432 GB,带宽为 19.6 TB/s,主要针对内存和带宽密集型大规模人工智能训练和推理任务。此外,英特尔的下一代人工智能加速器 Jaguar Shores 也将采用 HBM4 技术--虽然具体的带宽和容量数据尚未披露,但加入 HBM4 生态系统是一个明确的方向。.

实现无内存限制的大型模型训练

生成式人工智能训练,尤其是具有数千亿甚至数万亿参数的大型语言模型,是 HBM4 的核心应用场景。这些模型需要同时处理大量参数集和数据,对内存带宽和容量提出了极高的要求。HBM4 为每块加速卡提供 288-384 GB 的内存,这意味着单块加速卡就可以存储以前需要多块加速卡协同工作的大型模型参数和长上下文窗口。这样就不需要在训练过程中频繁地在加速卡之间分割数据,避免了模型分片带来的通信开销和效率损失,从而大大缩短了训练周期。在实际的人工智能服务部署中,HBM4 可以将大型模型推理性能提高 69% 以上。.

加速科学研究和模拟

在高性能计算领域,HBM4 为需要海量数据吞吐量的科学计算提供了关键的基础架构。无论是天气预报、量子计算模拟,还是基因组测序分析,都依赖于高带宽、大容量的内存系统。以天气预报为例:全球气象站、卫星和雷达每时每刻都在产生大量的实时数据。HBM4 可以快速处理这些数据流,让超级计算机在更短的时间内完成更详细的大气模型计算,从而提高极端天气预测的准确性和预警速度。在基因组测序方面,HBM4 可以同时比较和分析数百万个基因序列,加快疾病相关基因和药物靶点的鉴定,为新药开发节省宝贵的时间。.

扩展高端图形和专业可视化技术

虽然目前消费级显卡主要使用 GDDR 显存,但 HBM 系列凭借其超高的带宽和低功耗,一直是专业图形工作站和顶级游戏显卡的潜在选择。随着 HBM4 量产成本的逐步降低,普通用户有朝一日可能会在 8K 游戏、实时渲染和视频编辑等场景中享受到更流畅、更高效的内容创作体验。对于处理超高分辨率视频和复杂 3D 建模的专业人士来说,HBM4 将大大减少渲染等待时间,使创作过程更加流畅自然。.

HBM4 是第六代高带宽内存技术,通过 2048 位超宽接口、32 通道架构和混合绑定技术,实现了带宽和容量的双重飞跃。它是突破 “内存墙 ”瓶颈的关键内存解决方案。它不仅为人工智能训练、高性能计算和高端数据中心 GPU 提供了强大的存储支持,还标志着内存技术进入了混合绑定和 3D 堆叠的新时代。随着HBM4的大规模商用和技术的不断成熟,我们完全有理由相信,人工智能计算能力将迎来新一轮的爆发式增长,释放出更多的前沿技术和应用场景,为人类社会的发展带来巨大的变革。.