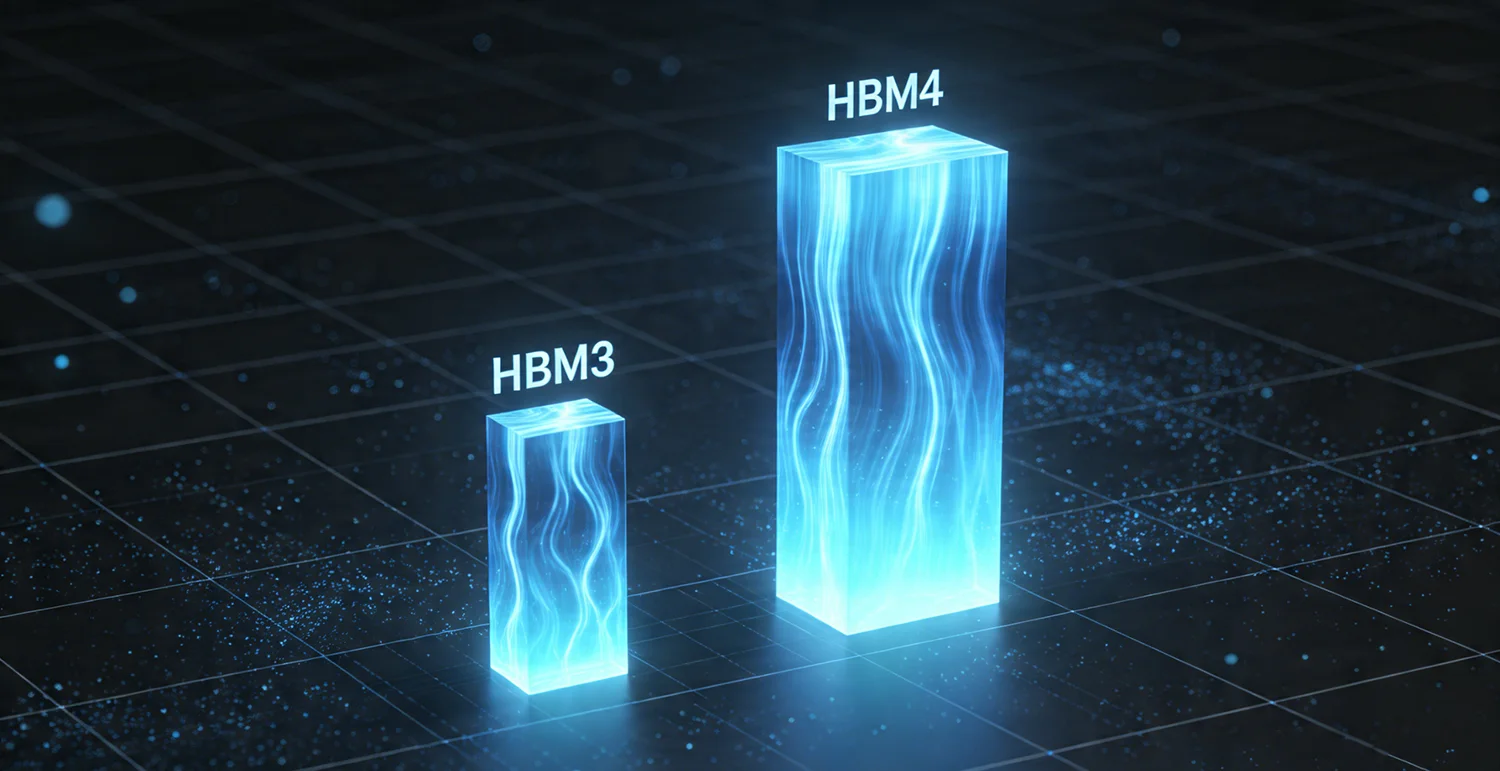

Nell'odierna era dell'intelligenza artificiale e dell'elaborazione ad alte prestazioni, la larghezza di banda della memoria è diventata un collo di bottiglia critico che limita la potenza di calcolo - quello che il settore chiama spesso il problema del “muro della memoria”. Immaginate la capacità di calcolo delle GPU come una catena di montaggio di una super-fabbrica, mentre la memoria tradizionale fornisce solo uno stretto “tubo di rifornimento di materie prime”, lasciando le costose risorse di calcolo inattive e in attesa di dati. Questa è la sfida principale che l'addestramento dell'intelligenza artificiale deve affrontare oggi. L'HBM4 (High Bandwidth Memory 4) è qui per rompere questo collo di bottiglia una volta per tutte, fornendo la spina dorsale di memoria essenziale per l'esplosione del calcolo guidato dall'IA.

Che cos'è l'HBM4?

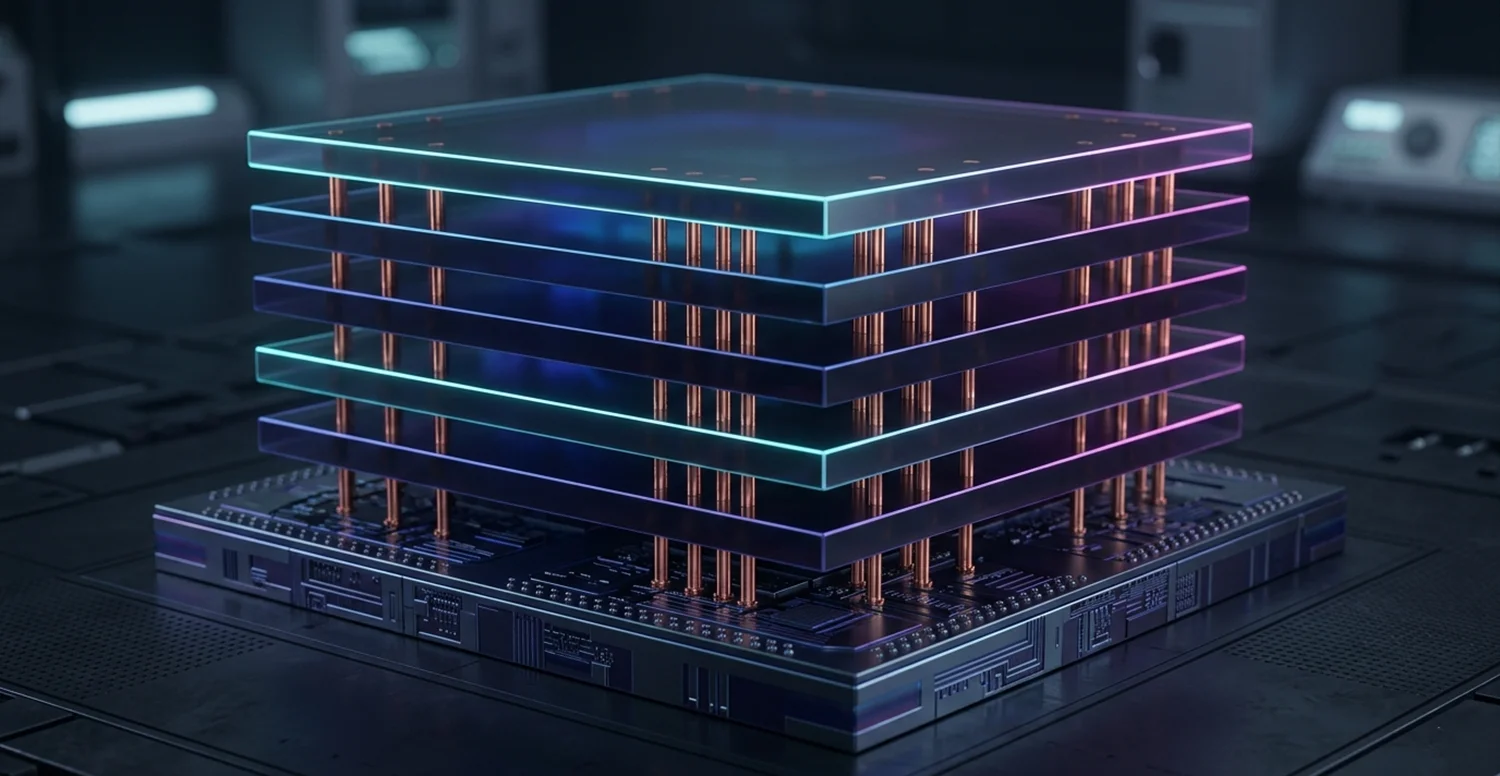

Memoria ad alta larghezza di banda è nata per risolvere il problema del “muro della memoria”, aumentando la larghezza di banda della memoria per sbloccare la potenza di calcolo. Adotta una filosofia di progettazione completamente diversa da quella delle memorie tradizionali: impilare verticalmente più chip DRAM e interconnetterli ad alta velocità utilizzando la tecnologia TSV (Through-Silicon Via), ottenendo un'enorme larghezza di trasferimento dati in un ingombro fisico estremamente ridotto. Dalla prima generazione di HBM del 2013 a oggi, questa famiglia si è evoluta nel corso di oltre un decennio e HBM4 è la sua ultima pietra miliare.

HBM4 è la tecnologia di memoria ad alta larghezza di banda di sesta generazione, rilasciata ufficialmente con il nome di Standard JESD270-4 dal JEDEC nell'aprile 2025. Come successore di HBM3/HBM3E, è stato progettato per l'addestramento dell'intelligenza artificiale, l'elaborazione ad alte prestazioni e le GPU dei data center di fascia alta. Prosegue l'architettura impilata 3D della famiglia HBM, impilando più chip DRAM in verticale e integrandoli con un die logico di base per ottenere una densità di banda estremamente elevata e un packaging compatto, tanto da meritarsi il soprannome di “super granaio” per l'AI compute.

Cosa rende la HBM4 così potente?

Rispetto alla precedente generazione di HBM3E, la HBM4 offre un salto di prestazioni completo. La tabella sottostante fornisce una rapida panoramica dei principali cambiamenti:

| Specifiche | HBM3 | HBM4 | Miglioramento |

|---|---|---|---|

| Larghezza dell'interfaccia | 1024 bit | 2048 bit | Raddoppiato |

| Larghezza di banda standard | ~819 GB/s | 2 TB/s | ~2.4× |

| Canali indipendenti | 16 | 32 | Raddoppiato |

| Capacità massima per pila | 24 GB (8-Hi) | 64 GB (16-Hi) | ~2.7× |

| Tensione di esercizio | Fisso ~1,1V | VDDQ 0,7-0,9V, VDDC 1,0-1,05V | Più flessibile, più efficiente |

Analizziamo ora il vero significato di questi numeri.

Interfaccia più ampia, maggiore larghezza di banda

L'HBM4 raddoppia l'interfaccia dati per stack da 1024 bit a 2048 bit. Che cosa significa? Le memorie DDR5 più avanzate oggi hanno un'interfaccia a canale singolo di soli 64 bit. Ciò significa che uno stack HBM4 ha l'equivalente larghezza di banda di 32 canali DDR5 che lavorano simultaneamente. Con il raddoppio dell'ampiezza dell'interfaccia, la larghezza di banda totale raddoppia automaticamente anche a parità di velocità di trasmissione dati. Inoltre, gli attuali prodotti dei fornitori funzionano spesso a velocità più elevate, per cui la larghezza di banda finale può facilmente superare i 2 TB/s, fino a raggiungere i 3 TB/s.

Più canali, programmazione dei dati più flessibile

Il numero di canali aumenta da 16 a 32 e ogni canale include due pseudo-canali. I canali possono essere considerati come “corsie” indipendenti all'interno della memoria: più canali significano che il sistema può emettere più richieste di accesso alla memoria contemporaneamente senza interferire l'una con l'altra. Ciò è particolarmente utile per le operazioni matriciali massicciamente parallele nell'elaborazione dell'intelligenza artificiale, riducendo in modo significativo la contesa sugli accessi e migliorando la larghezza di banda effettiva.

Capacità maggiore, per contenere l'intero modello

Aumentando gli strati di DRAM da un massimo di 8 a 16, un singolo stack di memoria HBM4 può raggiungere i 64 GB. Nei prodotti attuali, un acceleratore di intelligenza artificiale integra in genere da 4 a 8 stack HBM, il che significa che la capacità di memoria totale può facilmente superare i 256 GB o addirittura i 512 GB. Per i modelli di dimensioni trilioni di parametri, tale capacità consente ai parametri del modello e ai risultati intermedi di risiedere interamente nella memoria ad alta velocità, eliminando i frequenti trasferimenti dalla VRAM più lenta o dalla memoria di sistema.

Tensione più bassa, migliore efficienza energetica

La HBM4 introduce una gestione della tensione più raffinata. La tensione di I/O VDDQ può essere regolata fra 0,7V e 0,9V, mentre la tensione del core VDDC può essere selezionata fra 1,0V e 1,05V. Le tensioni più basse riducono direttamente il consumo di energia. Secondo i dati del fornitore, l'energia per bit trasferito della HBM4 è inferiore di circa 40% rispetto alla HBM3E. Per i grandi centri dati, ciò significa bollette elettriche più basse e minori esigenze di raffreddamento.

Nuova funzione di sicurezza: DRFM

L'HBM4 aggiunge anche un'importante caratteristica di affidabilità: il Directed Refresh Management (DRFM). Questa funzione difende efficacemente dagli attacchi “Row-Hammer”, una vulnerabilità di sicurezza in cui la lettura e la scrittura ripetute e rapide di righe di memoria adiacenti causano il ribaltamento dei bit nelle righe vicine. DRFM identifica in modo intelligente e aggiorna selettivamente tali righe, migliorando notevolmente la sicurezza della memoria e l'integrità dei dati.

Quali sono le principali innovazioni tecniche della HBM4?

Incollaggio ibrido

Il bonding ibrido è considerato la prossima soluzione rivoluzionaria per il packaging delle memorie. La tecnologia tradizionale dei micro-bump utilizza protuberanze metalliche su scala micron per collegare i chip, con un passo di circa 10μm, una limitazione fisica che impedisce un impilamento a più alta densità e una più rapida trasmissione del segnale. L'incollaggio ibrido elimina completamente queste protuberanze, preparando le superfici di rame di due chip in modo che siano atomicamente piatte e pulite, quindi mettendole a diretto contatto in modo che gli atomi di rame si diffondano e si fondano sotto temperatura e pressione.

Secondo i dati di prova pubblicati da Samsung, l'hybrid bonding può ridurre il passo dell'interconnessione chip-to-chip a meno di 10μm, aumentando la densità dell'interconnessione da diverse volte a decine di volte, offrendo al contempo una resistenza inferiore, percorsi di segnale più brevi e una migliore dissipazione del calore. I dati misurati da Samsung mostrano che il bonding ibrido bumpless può aumentare l'altezza dello stack HBM di un terzo e ridurre la resistenza termica di 20%. Tuttavia, poiché le apparecchiature per il bonding ibrido sono costose (circa il doppio di quelle tradizionali) e la resa della produzione di massa deve ancora essere migliorata, questa tecnologia non è ancora stata applicata agli attuali prodotti HBM4 prodotti in serie. Samsung ha spedito ai clienti campioni di HBM 16-Hi basati sul bonding ibrido, e si prevede che l'adozione commerciale inizi gradualmente a partire da HBM4E (la versione migliorata di HBM4).

Interfaccia distribuita e architettura pseudocanale

L'HBM4 adotta un design con 32 canali completamente indipendenti - il doppio rispetto all'HBM3 - e ogni canale è dotato di 2 pseudo-canali, che supportano 32 modalità DQ. Il vantaggio di questa architettura distribuita è che non richiede che tutti i canali operino in modo sincrono. Ogni canale può gestire le richieste di dati in modo indipendente, migliorando notevolmente l'efficienza dell'accesso parallelo. Questa soluzione è particolarmente adatta alle operazioni tensoriali e agli schemi di accesso irregolari ai dati nell'addestramento dei modelli di intelligenza artificiale.

Rispetto al design a canale singolo delle memorie tradizionali, l'architettura multicanale di HBM4 è come espandere un'autostrada a una corsia in 32 autostrade indipendenti a più corsie, ognuna delle quali è in grado di trasmettere i dati in modo efficiente allo stesso tempo, eliminando completamente gli ingorghi di dati e consentendo alle GPU di utilizzare al meglio la loro potenza di calcolo.

Progettazione ad ampia interfaccia e basso consumo

L'HBM4 utilizza la strategia “interfaccia ultra-larga + frequenza di clock relativamente bassa” per ottenere una larghezza di banda estremamente elevata mantenendo bassa la densità di potenza. Le memorie tradizionali spesso aumentano la larghezza di banda aumentando la frequenza di clock, il che comporta un consumo di energia nettamente superiore. La HBM4 fa il contrario: con un bus dati largo 2048 bit, offre un'ampiezza di banda molte volte superiore a quella delle memorie convenzionali a frequenze relativamente modeste. Questo progetto riduce l'energia per bit della HBM4 di 30-40%, un vantaggio significativo nella tendenza alla riduzione dei costi dell'intelligenza artificiale e al miglioramento dell'efficienza.

Inoltre, la HBM4 supporta l'ottimizzazione della tensione VDDQ specifica del fornitore (regolabile fra 0,7V e 0,9V), migliorando ulteriormente l'efficienza energetica. Ciò consente alle implementazioni di data center su larga scala di controllare efficacemente l'energia totale e di ridurre i costi operativi. Allo stesso tempo, la HBM4 mantiene la retrocompatibilità con i controller HBM3: un singolo controller può supportare entrambe le generazioni di memoria, riducendo la barriera degli aggiornamenti di sistema.

HBM4 Progressi e tabelle di marcia dei tre giganti

Samsung è il primo produttore al mondo ad annunciare la produzione di massa di HBM4. Il 12 febbraio 2026 Samsung Electronics ha annunciato di aver avviato la prima produzione commerciale di massa di HBM4 a livello globale e di aver iniziato le spedizioni ai clienti, utilizzando un die logico a 4 nm e una tecnologia di impilamento a 12-Hi, con una velocità di trasferimento dati di 11,7 Gbps e una larghezza di banda di 3,3 TB/s, superando di gran lunga lo standard JEDEC di 8 Gbps e 2 TB/s. Samsung prevede di introdurre campioni di HBM4E nella seconda metà del 2026 per migliorare ulteriormente le prestazioni, sviluppando anche una versione con stacking a 16-Hi che espande la capacità per-stack a 48 GB, aprendo la strada agli acceleratori AI di prossima generazione.

SK Hynix sta facendo rapidi progressi nello spazio HBM4. Secondo la sua roadmap tecnologica, nel 2026 prevede di lanciare un prodotto HBM4 impilato a 16-Hi con una capacità di 48 GB e un aggiornamento della larghezza dell'interfaccia unificata a 2048 bit. Sebbene l'azienda stia investendo attivamente in tecnologie di packaging di nuova generazione, come l'hybrid bonding, gli esemplari da 16-Hi finora dimostrati utilizzano ancora la matura tecnologia MR-MUF. SK Hynix prevede di avviare la produzione in volumi nel 2026, lavorando a stretto contatto con clienti importanti come NVIDIA e AMD.

Micron Technology ha confermato che la sua memoria HBM4 è entrata in produzione di massa nel primo trimestre del 2026, con spedizioni iniziali di versioni da 36 GB 12-Hi che offrono oltre 2,8 TB/s di banda passante di memoria. Il prodotto sarà costruito appositamente per la piattaforma Vera Rubin di NVIDIA per supportare l'addestramento dell'intelligenza artificiale nei data center di prossima generazione. Questa strategia di “personalizzazione su richiesta” posiziona Micron in modo favorevole all'interno di specifici segmenti di clienti.

In che modo l'HBM4 potenzierà l'IA e il calcolo ad alte prestazioni?

Acceleratori di IA di nuova generazione

L'HBM4 è diventata la memoria standard per le GPU dei data center di nuova generazione. I principali fornitori di chip per l'intelligenza artificiale - NVIDIA, AMD e Intel - stanno tutti adottando l'HBM4 nelle loro ultime piattaforme di accelerazione. Per esempio, sulla piattaforma Vera Rubin di NVIDIA, con otto stack HBM4, la banda passante teorica della memoria può raggiungere i 22 TB/s e, con una capacità di memoria iniziale di 288 GB, offre ampio spazio e canali di dati per l'addestramento di modelli da mille miliardi di parametri. Anche la serie Instinct MI400 di nuova generazione di AMD prevede robuste configurazioni HBM4: il modello MI455X sarà dotato di 12 stack HBM4, per un totale di 432 GB di capacità e 19,6 TB/s di larghezza di banda, per compiti di addestramento e inferenza AI su larga scala ad alta intensità di memoria e larghezza di banda. Inoltre, anche Jaguar Shores, l'acceleratore AI di prossima generazione di Intel, adotterà la tecnologia HBM4; sebbene non siano stati resi noti i dati specifici relativi alla larghezza di banda e alla capacità, l'adesione all'ecosistema HBM4 è una chiara direzione.

Consentire l'addestramento di modelli di grandi dimensioni senza vincoli di memoria

L'addestramento generativo dell'intelligenza artificiale, specialmente per i modelli linguistici di grandi dimensioni con centinaia di miliardi o addirittura trilioni di parametri, è lo scenario applicativo principale della HBM4. Questi modelli richiedono l'elaborazione simultanea di serie massicce di parametri e dati, ponendo requisiti estremamente impegnativi alla larghezza di banda e alla capacità della memoria. I 288-384 GB di memoria per scheda di accelerazione forniti dall'HBM4 significano che una singola scheda può contenere grandi parametri di modello e lunghe finestre di contesto che in precedenza richiedevano il lavoro congiunto di più schede. Ciò elimina la necessità di partizionare frequentemente i dati tra le schede durante l'addestramento, evitando l'overhead di comunicazione e le perdite di efficienza dovute allo sharding del modello, riducendo così in modo significativo i cicli di addestramento. Nell'effettiva implementazione dei servizi di intelligenza artificiale, l'HBM4 può migliorare le prestazioni di inferenza dei modelli di grandi dimensioni di oltre 69%.

Accelerare la ricerca scientifica e la simulazione

Nel calcolo ad alte prestazioni, l'HBM4 fornisce l'infrastruttura critica per l'elaborazione scientifica che richiede un'enorme quantità di dati. Che si tratti di previsioni meteorologiche, simulazione di calcolo quantistico o analisi del sequenziamento del genoma, tutti si basano su sistemi di memoria ad alta larghezza di banda e alta capacità. Prendiamo le previsioni del tempo: le stazioni meteorologiche globali, i satelliti e i radar generano ogni momento grandi quantità di dati in tempo reale. L'HBM4 è in grado di elaborare rapidamente questi flussi di dati, consentendo ai supercomputer di completare i calcoli dei modelli atmosferici più dettagliati in minor tempo, migliorando così l'accuratezza e la velocità di allarme delle previsioni meteorologiche estreme. Nel sequenziamento del genoma, l'HBM4 può confrontare e analizzare simultaneamente milioni di sequenze genetiche, accelerando l'identificazione dei geni correlati alle malattie e dei bersagli dei farmaci, risparmiando tempo prezioso per lo sviluppo di nuovi farmaci.

Espansione della grafica di alto livello e della visualizzazione professionale

Sebbene oggi le schede grafiche consumer utilizzino principalmente la memoria GDDR, la serie HBM è sempre stata una scelta potenziale per le workstation grafiche professionali e le schede di gioco di alto livello, grazie alla sua larghezza di banda ultraelevata e al basso consumo energetico. Con la graduale riduzione dei costi di produzione di massa dell'HBM4, un giorno gli utenti comuni potranno godere di esperienze di creazione di contenuti più fluide ed efficienti in scenari come i giochi 8K, il rendering in tempo reale e l'editing video. Per i professionisti che si occupano di video ad altissima risoluzione e di modellazione 3D complessa, l'HBM4 ridurrà significativamente i tempi di attesa del rendering, rendendo il processo creativo più fluido e naturale.

HBM4, la tecnologia di memoria ad alta larghezza di banda di sesta generazione, realizza un doppio salto di qualità in termini di larghezza di banda e capacità grazie all'interfaccia ultra-larga a 2048 bit, all'architettura a 32 canali e alla tecnologia di bonding ibrido. Si tratta di una soluzione di memoria fondamentale per superare il collo di bottiglia del “muro della memoria”. Non solo fornisce un potente supporto di memorizzazione per l'addestramento dell'intelligenza artificiale, l'elaborazione ad alte prestazioni e le GPU dei data center di fascia alta, ma segna anche l'inizio di una nuova era in cui la tecnologia di memoria entra nell'era dell'hybrid bonding e dello stacking 3D. Con la commercializzazione su larga scala dell'HBM4 e la continua maturazione della sua tecnologia, abbiamo tutte le ragioni per credere che la potenza di calcolo dell'intelligenza artificiale vedrà una nuova esplosione di crescita, sbloccando tecnologie e scenari applicativi sempre più all'avanguardia e apportando enormi cambiamenti allo sviluppo della società umana.