2026年3月24日、グーグルリサーチは正式に発表した。 ターボクワント - は、大規模な言語モデルの推論で使用されるキー・バリュー・キャッシュ(KVキャッシュ)を、以下のように圧縮する破壊的なAI圧縮技術です。 3ビット の精度を実現しました。これにより メモリ使用量を6倍削減 そして 推論速度が8倍向上しかし、モデルの精度はまったく低下していない。マイクロン・テクノロジーの株価は急落し、サムスンやSKハイニックスなどの大手企業も苦境に立たされ、合計で$900億ドル以上の市場価値が失われた。この技術は何がそんなに強力なのか?本当にストレージ業界を破壊するのだろうか?のようなストレージ製品はどうなるのだろうか? SSDDDR、および HBM 進化?

TurboQuantとは?

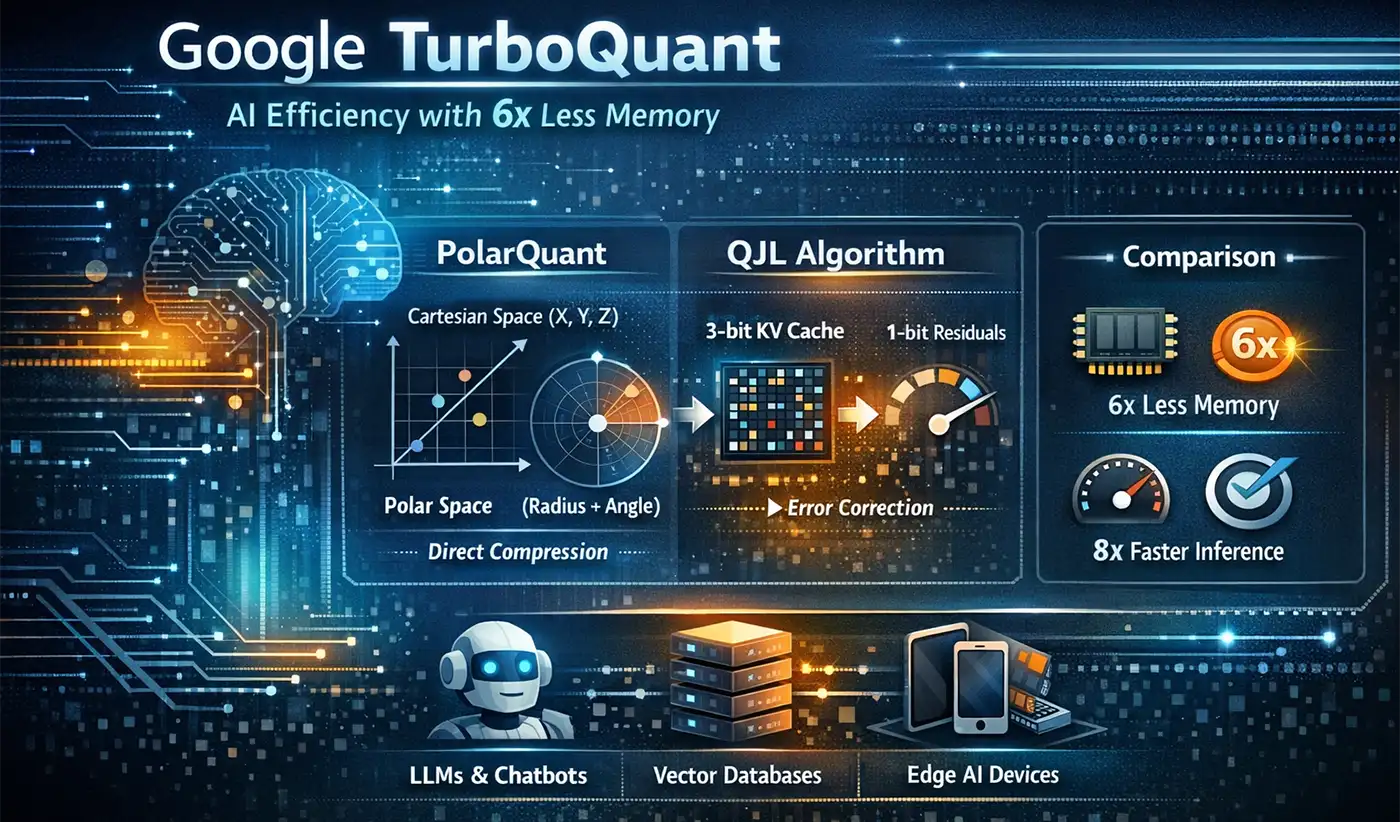

ターボクワント は 訓練不要でデータに偏りのないオンライン・ベクトル量子化アルゴリズム グーグル社によって開発された。これは、積極的に圧縮するように特別に設計されている。 キー・バリュー・キャッシュ(KVキャッシュ) 大規模言語モデルの推論中に

KVキャッシュは、モデルの推論中にコンテキスト情報を格納する一時的なデータ構造である。これは会話が長くなるにつれて継続的に増大し、モデルが長いテキストシーケンスを処理する能力を制限する重要なボトルネックとなる。従来の圧縮手法では、モデルの再トレーニング、大規模なキャリブレーションデータセット、量子化パラメータ用の追加ストレージが必要になることが多い。 TurboQuantのブレークスルーは、16/32ビットから3ビットまでの可逆圧縮を実現する能力にある。 モデルの調整、トレーニングデータ、余分なメモリオーバーヘッドを必要としない、真の「プラグアンドプレイ」ソリューションです。

2段階圧縮アーキテクチャ

TurboQuantの中核となるイノベーションは 二段階圧縮フレームワークこれは、効率と精度の理想的なバランスを達成するために、ブルートフォース量子化ではなく、数学的変換を使用しています:

ポラークアント:高次元ベクトルを直交座標から極座標に変換する。まず入力ベクトルにランダムな回転を加え、データの分布を均一にする。次に各ベクトルを 半径 (マグニチュードを表す)と 角度 (意味的な方向を表す)、角度のみを量子化する。この処理により、従来の手法で必要だった正規化パラメータを保存する必要が完全になくなる。

QJL (量子化ジョンソン-リンデンストラウス変換):これは残差補正の段階である。この段階では 1ビット (符号ビット)により、PolarQuantステージで導入された小さなエラーに偏りのない補正を適用し、注目の計算精度が損なわれないようにします。このステップにより、従来の圧縮方法に見られる誤差の蓄積の問題が解決され、次のような効果が得られます。 精度損失ゼロ 理論的には可能だ。

この「積極的な主圧縮+不偏的な残差補正」の組み合わせにより、TurboQuantは以下の性能を達成することができる。 3ビット精度 この事実は、LongBenchのような標準的なベンチマークによって検証されている。

主な特徴と利点

TurboQuantは、4つの核となる利点により、圧縮技術の中で際立っています:

トレーニングや微調整は不要:既存のモデル(Llama、Mistral、Gemma、Geminiなど)に直接適用することができ、調整や再トレーニングを必要としないため、すぐに導入することができる。

データに偏りなし:その性能は入力データの分布に依存せず、シナリオ固有の最適化を必要とせず、あらゆる種類のテキスト、コード、画像データに対して効果的に機能します。

ゼロ・オーバーヘッド:量子化パラメータや正規化係数などのための追加ストレージを必要としない。

理論的に最適:数学的に最適に近い歪み保証を提供し、大規模展開に信頼できる性能予測可能性を提供します。

Haloを覆う雲:学術的論争についての簡単なメモ

TurboQuantが市場に与えた衝撃と並行して、学術的な論争も起きている。3月27日、チューリッヒ工科大学のポスドク研究員であるJianyang Gao氏は、次のように述べた、 TurboQuant社のコア手法はRaBitQに酷似していると公に主張されている。彼は2024年にSIGMODで発表したアルゴリズムである。高氏は、Googleチームの論文は方法論的な類似性の議論を避け、RaBitQの理論的な結果を正当な理由なく「最適以下」と貶め、不公平な実験比較(RaBitQをシングルコアCPUでテストし、TurboQuantをA100 GPUでテスト)を行っていると指摘した。

高氏によると、これらの問題は論文発表前に電子メールでグーグル・チームに伝えられたという。グーグル・チームはいくつかの問題を認めたものの、カンファレンス後に修正することを約束しただけで、技術的な類似性は否定したと伝えられている。月31日現在、RaBitQチームは ICLR OpenReviewにパブリックコメントを投稿しました。 とICLR大会倫理委員会に正式な苦情を申し立てた。この論争は、注意喚起の役割を果たしている:TurboQuantの技術的価値が完全に検証されるにはまだ時間が必要であり、それに関わる学問的行為の問題も同様に注目に値する。

ストレージ業界への潜在的影響

市場の反応を合理的に見る

ターボクワントの発表後、ストレージ・チップの株価が急落したのは、そのためというよりも、このような事態を避けるためだった。 市場心理による過剰反応 合理的な評価よりも。真の影響を理解するためには、まずTurboQuantを定義することが重要である。 影響範囲:

推論にのみ影響:HBMのようなハイエンド・メモリの需要の中心であるモデル・トレーニング・プロセスには何の影響もありません。

KVキャッシュのみを圧縮:モデルのウェイト、アクティベーション、その他のコアデータは影響を受けない。これらはストレージリソースの主な消費者である。

効率向上のパラドックス:過去の経験から、計算効率の向上はしばしば大規模なアプリケーションにつながる可能性がある。 増加 全体的な貯蔵需要は、むしろ減少する(ジェヴォンズのパラドックス)。

SSD、DDR、HBMへの潜在的影響

TurboQuantはデュアルインパクトDDRメモリを搭載している可能性があります。 一方では、KVキャッシュをよりコスト効率よくHBMに格納できるようにすることで、HBMへの依存度を下げている。 DDR5/DDR6を、高価なHBMを必要とする代わりに使用することができます。これにより、高帯域幅の DDR5-8800+ および 将来のDDR6TurboQuantは、AIサーバーにおけるHBMに代わるコスト効率の高い選択肢として位置づけられる。一方、TurboQuantはCXLメモリ拡張技術の採用を加速します。CXLを介してDDRメモリーをプールすることで、AIサーバーはメモリー・リソースをより柔軟に割り当ててさまざまな規模の推論タスクを処理できるようになり、DDRの利用効率と市場の需要がさらに高まります。

市場の懸念とは裏腹に、TurboQuantはSSDにとって大きなプラスとなりそうだ:

ロング・コンテクスト・オーバーフロー・ストレージ:KVキャッシュがメモリ容量を超えた場合、低レイテンシで高耐久性のSSD(pSLCモード、NVMe 4.0/5.0など)が理想的なセカンダリキャッシュとなり、エンタープライズグレードSSDのパフォーマンスと容量に対する需要を大幅に押し上げる。

ベクター・データベースの拡張TurboQuantが牽引するRAG(Retrieval-Augmented Generation)システムの採用増加は、基礎ストレージとして高性能SSDに大きく依存するベクトルデータベースの成長に直接的に拍車をかけるだろう。

エッジAIの展開:TurboQuantは、コンシューマーグレードのデバイス上でAIモデルを実行することを可能にし、クライアントサイドSSDの市場を拡大し、特に低消費電力で高性能なSSDへの需要を高めます。 M.2 SSD.

HBMに関する市場のパニックは行き過ぎたようだ:

トレーニングと推論の明確な区別:TurboQuantは推論中のKVキャッシュにのみ影響します。HBM上でのモデルトレーニングに必要な帯域幅の需要は減少していません。HBMは、超大規模モデルのトレーニングに不可欠な要件であり続けています。

モデル重量保管に影響なし: AIメモリ消費の90%以上を占めるモデルウェイトは、TurboQuantでは圧縮されません。これらの重みを保存する主要な媒体としてのHBMの役割は、引き続き安全です。

ハイブリッド・アーキテクチャの最適化:TurboQuantは、HBMリソースを重要なコンピューティング・タスクにより効率的に割り当てることを可能にし、単純な置き換えではなく、HBM、DDR、SSDを組み合わせたハイブリッド・ストレージ・アーキテクチャの開発を促進します。

AIインフラの新たなパラダイムの可能性

TurboQuantの真の価値は、特定の種類のストレージを「排除」することではなく、AIインフラのストレージ階層アーキテクチャを再構築し、より効率的かつ経済的なメモリ-ストレージ階層の構築を推進することにあります。

インテリジェントなデータフローの新秩序

将来のAIサーバー・ストレージ・アーキテクチャは、明確な3層ピラミッドを特徴とする可能性が高い:

トップ・ティア - HBM:モデルのウェイトやアクティベーションのような中核となる計算データの保存を担当し、トレーニングや推論タスクの帯域幅集約的な要求を満たす。

ミドル層 - DDR:KVキャッシュの主要キャリアとして機能。TurboQuantの圧縮効率の恩恵を受け、DDR5/DDR6が、KVキャッシュの主要キャリアとなります。 ワークホースメモリ 推論シナリオ

最下層 - SSD:長いコンテキストのオーバーフロー、ベクトル・データベース、モデルのチェックポイントを処理します。低レイテンシ、高耐久性のエンタープライズSSDは、新たな成長機会に遭遇するだろう。

この階層型アーキテクチャーの中核は インテリジェントなデータ配置 - アクセス頻度、レイテンシ要件、ストレージコストに基づいて階層間で動的にデータを移動し、パフォーマンスとコストの最適なバランスを実現する。

ソフトウェア定義ストレージの台頭

TurboQuantの採用が加速する可能性がある。 ソフトウェア定義ストレージ(SDS) AI、特に以下の分野で:

メモリー管理システム:KVキャッシュのサイズをリアルタイムで監視し、データをHBMに保持するか、DDRに保持するか、SSDにオーバーフローさせるかをインテリジェントに決定できる管理ソフトウェアは、AIインフラの標準的な構成要素になるだろう。

CXLメモリ・プーリング:CXLプロトコルを介して複数のサーバからDDRメモリリソースをプールすることで、AIクラスタに弾力的にスケーラブルなメモリリソースを提供し、個々のサーバあたりのHBM容量要件をさらに削減します。

圧縮対応ストレージ:ストレージデバイスは、TurboQuantのような圧縮アルゴリズムをネイティブにサポートし始め、ハードウェアレベルで高速なデータ圧縮と解凍を可能にし、システム全体の効率を向上させる。

TurboQuantのリリースは、ストレージ業界の破滅の前兆ではなく、むしろ次のようなものだ。 ストレージとAIをより深く統合するための新たな出発点.単にある種のストレージ製品を「排除」するものではない。その代わりに、圧縮技術における画期的なブレークスルーによって、ストレージ業界をより高い効率性とインテリジェンスへと向かわせるだろう。つまり、将来のAIサービスは、より長い文章を処理し、より正確な回答を提供できるようになり、同時にハードウェア・コストを削減できる可能性があるということだ。真の技術革新とは、決して単純な置き換えではなく、イノベーションを通じてリソースの利用効率を飛躍的に向上させ、より幅広いアプリケーションへの扉を開くことなのだ。