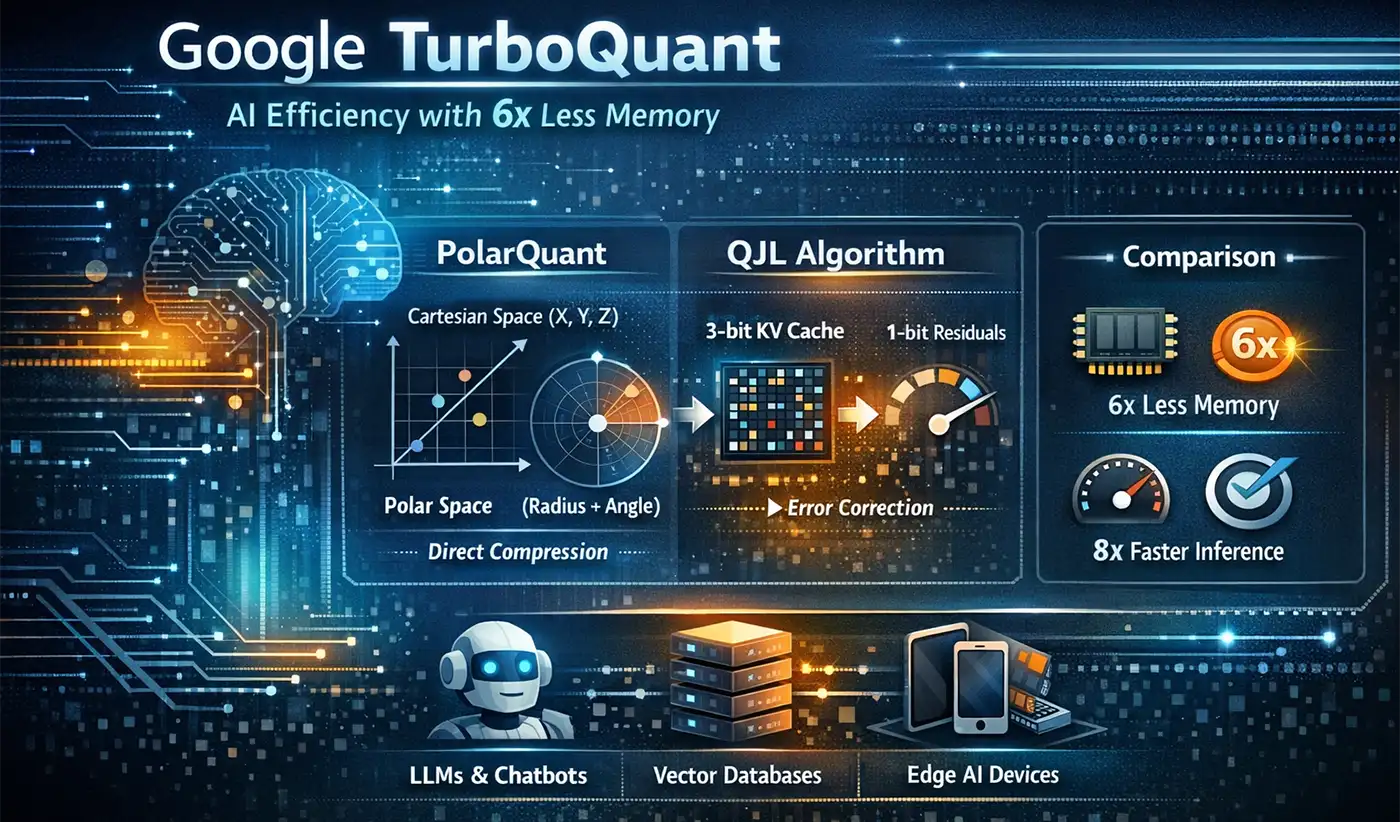

Le 24 mars 2026, Google Research a officiellement dévoilé TurboQuant - une technologie disruptive de compression de l'IA qui compresse le cache clé-valeur (KV Cache) utilisé lors de l'inférence d'un modèle de langage de grande taille jusqu'à 3 bits précision. Cela permet d'obtenir une Réduction par 6 de l'utilisation de la mémoire et jusqu'à un Vitesse d'inférence multipliée par 8, et ce, sans aucune perte de précision du modèle. L'annonce a déclenché une volatilité immédiate sur le marché mondial des puces mémoire, avec une chute du cours de l'action de Micron Technology et des acteurs majeurs comme Samsung et SK Hynix qui ont également souffert, perdant collectivement plus de $90 milliards d'euros en valeur de marché. Qu'est-ce qui rend cette technologie si puissante ? Va-t-elle réellement perturber le secteur du stockage ? Comment les produits de stockage tels que les SSD, DDR, et HBM évoluer ?

Qu'est-ce que TurboQuant ?

TurboQuant est un algorithme de quantification vectorielle en ligne sans apprentissage et sans biais de données développé par Google Research. Il est spécifiquement conçu pour compresser de manière agressive les cache clé-valeur (KV Cache) pendant l'inférence d'un grand modèle linguistique.

Le cache KV est une structure de données temporaire qui stocke les informations contextuelles pendant l'inférence du modèle. Il croît continuellement avec les conversations longues, devenant un goulot d'étranglement critique qui limite la capacité d'un modèle à traiter de longues séquences de texte. Les méthodes de compression traditionnelles nécessitent souvent un recyclage du modèle, de grands ensembles de données d'étalonnage ou un stockage supplémentaire pour les paramètres de quantification. La percée de TurboQuant réside dans sa capacité à réaliser une compression sans perte de 16/32 bits jusqu'à 3 bits. sans ajustement de modèle, sans données d'apprentissage et sans surcharge de mémoire - une véritable solution “prête à l'emploi”.

Architecture de compression en deux étapes

L'innovation principale de TurboQuant est son cadre de compression en deux étapes, qui utilise des transformations mathématiques plutôt qu'une quantification brute pour atteindre un équilibre idéal entre efficacité et précision :

PolarQuant: Il s'agit de la principale étape de compression, qui transforme les vecteurs à haute dimension de coordonnées cartésiennes en coordonnées polaires. Elle applique d'abord une rotation aléatoire aux vecteurs d'entrée afin d'uniformiser la distribution des données. Il décompose ensuite chaque vecteur en rayon (représentant l'ampleur) et angle (représentant la direction sémantique), en quantifiant uniquement l'angle. Ce processus élimine complètement la nécessité de stocker les paramètres de normalisation requis par les méthodes traditionnelles.

QJL (Transformée de Johnson-Lindenstrauss quantifiée): Il s'agit de l'étape de correction des résidus. Elle utilise 1-bit (bit de signe) pour appliquer une correction impartiale aux petites erreurs introduites au cours de l'étape PolarQuant, en veillant à ce que la précision du calcul de l'attention ne soit pas compromise. Cette étape résout le problème de l'accumulation d'erreurs que l'on trouve dans les méthodes de compression traditionnelles, ce qui rend le calcul de l'attention plus précis. perte de précision nulle théoriquement possible.

Cette combinaison de “compression principale agressive + correction résiduelle non biaisée” permet à TurboQuant d'atteindre des performances à Précision de 3 bits qui égalent, voire dépassent, les lignes de base en pleine précision, ce qui est validé par des critères de référence standard tels que LongBench.

Principales caractéristiques et avantages

TurboQuant se distingue des autres techniques de compression par quatre avantages fondamentaux :

Aucune formation ou mise au point n'est nécessaire: Il peut être appliqué directement aux modèles existants (Llama, Mistral, Gemma, Gemini, etc.) sans aucun ajustement ou recyclage, ce qui permet un déploiement immédiat.

Données impartiales: Ses performances sont indépendantes de la distribution des données d'entrée et fonctionnent efficacement sur tous les types de textes, de codes et d'images sans nécessiter d'optimisation spécifique à un scénario.

Zéro frais généraux: Elle ne nécessite pas de stockage supplémentaire pour les paramètres de quantification, les facteurs de normalisation, etc.

Optimal en théorie: Il offre des garanties de distorsion mathématiquement quasi-optimales, ce qui permet de prévoir les performances de manière fiable pour un déploiement à grande échelle.

Un nuage au-dessus du Halo : une brève note sur la controverse académique

Parallèlement à l'onde de choc provoquée par TurboQuant sur les marchés, un différend académique est apparu. Le 27 mars, Jianyang Gao, post-doctorant à l'ETH de Zurich, a déclaré : "Nous sommes en train d'étudier la possibilité de créer un nouveau système de gestion de l'information, a publiquement allégué que la méthodologie de base de TurboQuant est très similaire à celle de RaBitQ, un algorithme qu'il a publié en 2024 à SIGMOD. M. Gao a souligné que l'article de l'équipe de Google évitait de discuter des similitudes méthodologiques, dénigrait les résultats théoriques de RaBitQ en les qualifiant de “sous-optimaux” sans justification, et utilisait des comparaisons expérimentales injustes (en testant RaBitQ sur un processeur à cœur unique et TurboQuant sur un GPU A100).

Selon M. Gao, ces problèmes ont été communiqués à l'équipe de Google par courrier électronique avant la publication du document. Bien que l'équipe de Google ait reconnu certains problèmes, elle aurait seulement promis d'apporter des corrections après la conférence et nié les similitudes techniques. Au 31 mars, l'équipe de RaBitQ a a publié un commentaire public sur ICLR OpenReview et a déposé une plainte officielle auprès du comité d'éthique de la conférence de l'ICLR. Cette controverse nous rappelle que la valeur technique de TurboQuant a encore besoin de temps pour être pleinement validée : La valeur technique de TurboQuant a encore besoin de temps pour être pleinement validée, et les problèmes de conduite académique qui en découlent sont tout aussi notables.

Impact potentiel sur le secteur du stockage

Un regard rationnel sur la réaction des marchés

La forte baisse des stocks de puces de stockage à la suite de l'annonce de TurboQuant a plutôt été un signe d'un changement de comportement. surréaction due au sentiment du marché qu'une évaluation rationnelle. Pour comprendre l'impact réel, il est essentiel de définir tout d'abord l'approche de TurboQuant. champ d'influence:

N'affecte que l'inférence: Elle n'a pas d'impact sur le processus d'apprentissage du modèle, qui est le scénario de base de la demande de mémoire haut de gamme comme la mémoire HBM.

Compresse uniquement le cache KV: Les poids du modèle, les activations et les autres données de base ne sont pas affectés. Ce sont les principaux consommateurs de ressources de stockage.

Le paradoxe des gains d'efficacité: L'expérience historique suggère que les améliorations de l'efficacité des calculs conduisent souvent à des applications à plus grande échelle, ce qui peut avoir des conséquences négatives sur la qualité de la vie. en augmentation la demande globale de stockage au lieu de la diminuer (paradoxe de Jevons).

Impacts potentiels sur les SSD, DDR et HBM

TurboQuant peut avoir une mémoire DDR à double impact. D'une part, il réduit la dépendance à l'égard de la mémoire HBM en permettant au KV Cache d'être stocké de manière plus rentable dans la mémoire HBM, et d'autre part, il réduit la dépendance à l'égard du HBM. DDR5/DDR6 au lieu d'avoir recours à la coûteuse technologie HBM. Cela crée de nouvelles opportunités pour les DDR5-8800+ à large bande passante et les DDR6. future DDR6, ce qui les positionne comme une alternative rentable à la mémoire HBM dans les serveurs d'intelligence artificielle. D'autre part, TurboQuant accélère l'adoption de la technologie d'extension de mémoire CXL. En regroupant la mémoire DDR via le CXL, les serveurs d'intelligence artificielle peuvent allouer les ressources mémoire de manière plus souple pour traiter des tâches d'inférence de taille variable, ce qui améliore encore l'efficacité de l'utilisation de la mémoire DDR et la demande du marché.

Contrairement aux inquiétudes du marché, TurboQuant est probablement une évolution positive significative pour les disques SSD :

Stockage de débordement à long terme: Lorsque le KV Cache dépasse la capacité de la mémoire, les disques SSD à faible latence et à haute endurance (comme le mode pSLC, NVMe 4.0/5.0) deviennent le cache secondaire idéal, ce qui stimule considérablement la demande de performance et de capacité des disques SSD d'entreprise.

Extension de la base de données vectorielles: L'adoption croissante des systèmes RAG (Retrieval-Augmented Generation), sous l'impulsion de TurboQuant, alimentera directement la croissance des bases de données vectorielles, qui s'appuient fortement sur des disques SSD de haute performance pour leur stockage sous-jacent.

Déploiement de l'IA en périphérie: TurboQuant permet d'exécuter des modèles d'IA sur des appareils grand public, élargissant ainsi le marché des disques SSD côté client, en particulier en augmentant la demande de disques SSD à faible consommation d'énergie et à haute performance. Disques SSD M.2.

La panique du marché à l'égard de HBM semble exagérée :

Distinction claire entre formation et déduction: TurboQuant n'affecte le cache KV que pendant l'inférence. Les besoins en bande passante pour l'apprentissage de modèles sur HBM restent inchangés ; HBM reste une exigence essentielle pour l'apprentissage de modèles à très grande échelle.

Le stockage du poids du modèle n'est pas affecté : Les poids des modèles, qui représentent plus de 90% de la consommation de mémoire de l'IA, ne sont pas compressés par TurboQuant. Le rôle de HBM en tant que support principal pour le stockage de ces poids reste sécurisé.

Optimisation de l'architecture hybride: TurboQuant permet d'allouer plus efficacement les ressources HBM aux tâches informatiques critiques, ce qui favorise le développement d'architectures de stockage hybrides combinant HBM, DDR et SSD, plutôt qu'un simple remplacement.

Nouveau paradigme potentiel pour l'infrastructure de l'IA

La valeur réelle de TurboQuant ne réside pas dans l“”élimination" d'un type de stockage spécifique, mais dans le remodelage de l'architecture de stockage de l'infrastructure d'IA, entraînant la création d'une hiérarchie mémoire-stockage plus efficace et plus économique.

Un nouvel ordre de flux de données intelligent

Les futures architectures de stockage des serveurs d'IA devraient présenter une pyramide claire à trois niveaux :

Niveau supérieur - HBM: Responsable du stockage des données de calcul de base telles que les poids et les activations du modèle, répondant aux demandes de bande passante des tâches d'apprentissage et d'inférence.

Niveau intermédiaire - DDR: sert de support principal pour le cache KV. Bénéficiant de l'efficacité de compression de TurboQuant, les DDR5/DDR6 deviendront le support principal du cache KV. mémoire de travail pour les scénarios d'inférence.

Niveau inférieur - SSD: Gère les dépassements de contexte longs, les bases de données vectorielles et les points de contrôle des modèles. Les disques SSD d'entreprise à faible latence et à haute résistance vont connaître de nouvelles opportunités de croissance.

Le cœur de cette architecture à plusieurs niveaux est placement intelligent des données - déplacer dynamiquement les données entre les niveaux en fonction de la fréquence d'accès, des exigences de latence et du coût du stockage, afin d'obtenir un équilibre optimal entre les performances et les coûts.

L'essor du stockage défini par logiciel

TurboQuant peut accélérer l'adoption de la technologie Stockage défini par logiciel (SDS) dans l'IA, en particulier dans les domaines suivants :

Systèmes de gestion de la mémoire: Les logiciels de gestion capables de surveiller la taille du cache KV en temps réel et de décider intelligemment s'il faut conserver les données dans HBM, DDR ou les faire déborder sur les disques SSD deviendront un composant standard de l'infrastructure d'IA.

Mise en commun de la mémoire CXL: La mise en commun des ressources de mémoire DDR de plusieurs serveurs via le protocole CXL fournira des ressources de mémoire élastiquement évolutives pour les grappes d'IA, ce qui réduira encore les besoins en capacité HBM par serveur individuel.

Stockage avec compression: Les dispositifs de stockage commenceront à prendre en charge de manière native des algorithmes de compression tels que TurboQuant, permettant une compression et une décompression rapides des données au niveau matériel afin d'améliorer l'efficacité globale du système.

La sortie de TurboQuant n'est pas un présage de malheur pour l'industrie du stockage, mais plutôt un signe d'espoir pour l'avenir. nouveau point de départ pour une intégration plus poussée entre le stockage et l'IA.. Il ne se contentera pas d“”éliminer" un certain type de produit de stockage. Au contraire, grâce à une percée révolutionnaire dans la technologie de compression, elle conduira l'industrie du stockage vers plus d'efficacité et d'intelligence. Cela signifie que les futurs services d'IA seront capables de traiter des textes plus longs, de fournir des réponses plus précises, tout en réduisant potentiellement les coûts de matériel. Une véritable révolution technologique ne consiste jamais en un simple remplacement, mais à réaliser un bond dans l'efficacité de l'utilisation des ressources grâce à l'innovation, ouvrant ainsi la voie à des applications plus larges.