Am 24. März 2026 enthüllte Google Research offiziell TurboQuant - eine bahnbrechende KI-Komprimierungstechnologie, die den Key-Value-Cache (KV-Cache), der bei der Inferenz großer Sprachmodelle verwendet wird, auf ein Minimum komprimiert 3-Bit Präzision. Dadurch wird eine 6-fache Reduzierung der Speichernutzung und bis zu einem 8-fache Steigerung der Inferenzgeschwindigkeit, und das alles ohne Einbußen bei der Modellgenauigkeit. Die Ankündigung löste eine unmittelbare Volatilität auf dem weltweiten Markt für Speicherchips aus. Der Aktienkurs von Micron Technology stürzte ab, und auch große Unternehmen wie Samsung und SK Hynix mussten Einbußen hinnehmen und verloren insgesamt über $90 Mrd. EUR an Marktwert. Was macht diese Technologie so leistungsstark? Wird sie die Speicherbranche wirklich umkrempeln? Wie werden Speicherprodukte wie SSDs, DDR, und HBM sich weiterentwickeln?

Was ist TurboQuant?

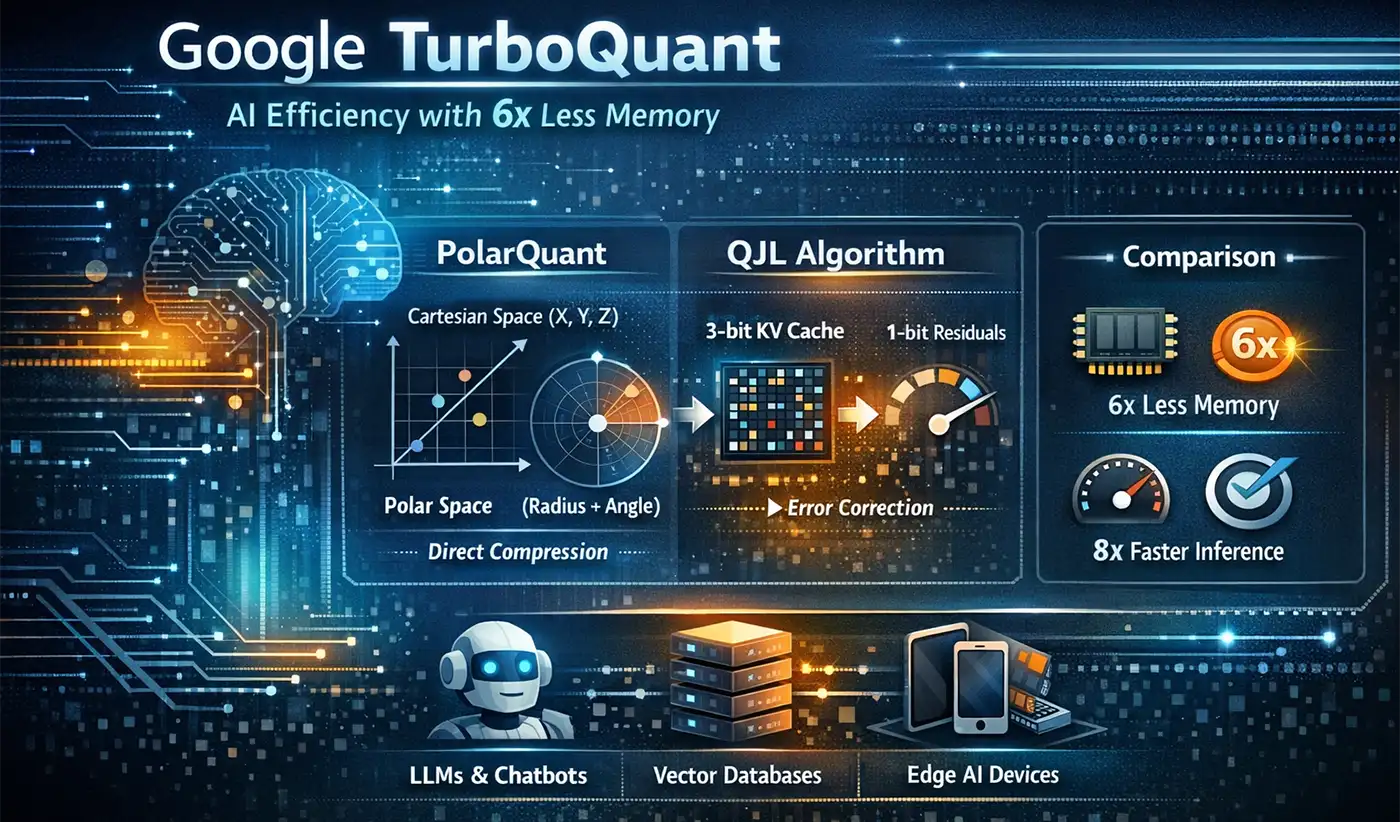

TurboQuant ist eine trainingsfreier, datenunabhängiger Online-Vektorquantisierungsalgorithmus entwickelt von Google Research. Es wurde speziell für eine aggressive Komprimierung der Schlüssel-Wert-Cache (KV-Cache) während der Inferenz großer Sprachmodelle.

Der KV-Cache ist eine temporäre Datenstruktur, die Kontextinformationen während der Modellinferenz speichert. Er wächst bei längeren Unterhaltungen kontinuierlich an und wird so zu einem kritischen Engpass, der die Fähigkeit eines Modells, lange Textsequenzen zu verarbeiten, einschränkt. Herkömmliche Komprimierungsmethoden erfordern häufig ein erneutes Modelltraining, große Kalibrierungsdatensätze oder zusätzlichen Speicherplatz für Quantisierungsparameter. Der Durchbruch von TurboQuant liegt in seiner Fähigkeit, eine verlustfreie Kompression von 16/32 Bit auf 3 Bit zu erreichen. ohne Modellanpassungen, Trainingsdaten oder zusätzlichen Speicherbedarf - eine echte “Plug-and-Play”-Lösung.

Zweistufige Komprimierungsarchitektur

Die Kerninnovation von TurboQuant ist seine zweistufiger Komprimierungsrahmen, die mathematische Transformationen anstelle von Brute-Force-Quantisierung verwendet, um ein ideales Gleichgewicht zwischen Effizienz und Genauigkeit zu erreichen:

PolarQuant: Dies ist die Hauptkomprimierungsstufe, die hochdimensionale Vektoren von kartesischen in polare Koordinaten umwandelt. Zunächst wird eine zufällige Drehung auf die Eingangsvektoren angewandt, um die Datenverteilung zu vereinheitlichen. Anschließend wird jeder Vektor zerlegt in Radius (zur Darstellung der Größenordnung) und Winkel (zur Darstellung der semantischen Richtung), wobei nur der Winkel quantisiert wird. Dieses Verfahren macht die Speicherung von Normalisierungsparametern, wie sie bei herkömmlichen Methoden erforderlich sind, vollständig überflüssig.

QJL (Quantisierte Johnson-Lindenstrauss-Transformation): Dies ist die Phase der Restkorrektur. Sie verwendet 1-Bit (Vorzeichenbit), um eine unvoreingenommene Korrektur der kleinen Fehler vorzunehmen, die während der PolarQuant-Phase entstanden sind, so dass die Genauigkeit der Aufmerksamkeitsberechnung nicht beeinträchtigt wird. Dieser Schritt löst das Problem der Fehlerakkumulation, das bei herkömmlichen Kompressionsmethoden auftritt, und macht Null-Präzisionsverlust theoretisch möglich.

Diese Kombination aus “aggressiver Hauptkompression + unverzerrter Restkorrektur” ermöglicht es TurboQuant, eine Leistung bei 3-Bit-Präzision die mit der Basispräzision übereinstimmt oder diese sogar übertrifft, was durch Standardbenchmarks wie LongBench bestätigt wird.

Hauptmerkmale und Vorteile

TurboQuant zeichnet sich unter den Kompressionstechniken durch vier wesentliche Vorteile aus:

Keine Schulung oder Feinabstimmung erforderlich: Es kann direkt auf bestehende Modelle (Llama, Mistral, Gemma, Gemini usw.) angewandt werden, ohne dass Anpassungen oder Umschulungen erforderlich sind, so dass es sofort eingesetzt werden kann.

Daten Unvoreingenommenheit: Seine Leistung ist unabhängig von der Verteilung der Eingabedaten und arbeitet effektiv mit allen Arten von Text-, Code- und Bilddaten, ohne dass eine szenariospezifische Optimierung erforderlich ist.

Kein Overhead: Es erfordert keine zusätzliche Speicherung von Quantisierungsparametern, Normalisierungsfaktoren usw., ganz im Gegensatz zu herkömmlichen Methoden.

Theoretisch optimal: Es bietet mathematisch nahezu optimale Verzerrungsgarantien und damit eine zuverlässige Leistungsvorhersage für den Einsatz in großem Maßstab.

Wolke über dem Halo: Eine kurze Anmerkung zur akademischen Kontroverse

Neben den Schockwellen, die TurboQuant am Markt ausgelöst hat, ist auch ein akademischer Streit entstanden. Am 27. März stellte Jianyang Gao, ein Postdoktorand an der ETH Zürich, fest, öffentlich behauptet, dass die Kernmethodik von TurboQuant der von RaBitQ sehr ähnlich ist, einen Algorithmus, den er 2024 auf der SIGMOD veröffentlichte. Gao wies darauf hin, dass das Papier des Google-Teams es vermied, methodische Ähnlichkeiten zu erörtern, die theoretischen Ergebnisse von RaBitQ ohne Begründung als “suboptimal” verunglimierte und unfaire experimentelle Vergleiche anstellte (RaBitQ wurde auf einer Single-Core-CPU getestet, während TurboQuant auf einem A100-GPU getestet wurde).

Laut Gao wurden diese Probleme dem Google-Team vor der Veröffentlichung des Papiers per E-Mail mitgeteilt. Das Google-Team räumte zwar einige Probleme ein, versprach aber Berichten zufolge nur, nach der Konferenz Korrekturen vorzunehmen, und bestritt die technischen Ähnlichkeiten. Mit Stand vom 31. März hat das RaBitQ-Team einen öffentlichen Kommentar zu ICLR OpenReview abgegeben und reichte eine formelle Beschwerde bei der Ethikkommission der ICLR-Konferenz ein. Diese Kontroverse dient als Mahnung: Der technische Wert von TurboQuant muss erst noch vollständig validiert werden, und die damit verbundenen Fragen des akademischen Verhaltens sind ebenso beachtenswert.

Mögliche Auswirkungen auf die Speicherindustrie

Ein rationaler Blick auf die Marktreaktion

Der starke Rückgang der Speicherchip-Aktien nach der Ankündigung von TurboQuant war eher eine Überreaktion aufgrund der Marktstimmung als eine rationale Bewertung. Um die wahren Auswirkungen zu verstehen, ist es zunächst wichtig, die TurboQuant's Einflussbereich:

Beeinflusst nur die Inferenz: Es hat keine Auswirkungen auf den Modellbildungsprozess, der das Hauptanforderungsszenario für High-End-Speicher wie HBM ist.

Komprimiert nur den KV-Cache: Modellgewichte, Aktivierungen und andere Kerndaten sind davon nicht betroffen. Diese sind die Hauptverbraucher von Speicherressourcen.

Das Paradoxon der Effizienzgewinne: Die Erfahrung zeigt, dass Verbesserungen der Rechenleistung oft zu größeren Anwendungen führen, die möglicherweise Erhöhung den Gesamtbedarf an Speicherplatz zu erhöhen, anstatt ihn zu verringern (Jevons-Paradoxon).

Mögliche Auswirkungen auf SSD, DDR und HBM

TurboQuant kann einen DDR-Speicher mit doppelter Wirkung haben. Einerseits wird die Abhängigkeit von HBM verringert, da der KV-Cache kostengünstiger in einem Speicher abgelegt werden kann. DDR5/DDR6, anstatt teures HBM zu benötigen. Dies schafft neue Möglichkeiten für DDR5-8800+ mit hohen Bandbreiten und zukünftiges DDR6, und positioniert sie als kostengünstige Alternative zu HBM in KI-Servern. Auf der anderen Seite beschleunigt TurboQuant die Einführung der CXL-Speichererweiterungstechnologie. Durch die Bündelung von DDR-Speicher über CXL können KI-Server Speicherressourcen flexibler zuweisen, um Inferenzaufgaben unterschiedlicher Größe zu bewältigen, was die Effizienz der DDR-Nutzung und die Marktnachfrage weiter steigert.

Entgegen den Befürchtungen des Marktes ist TurboQuant wahrscheinlich eine bedeutende positive Entwicklung für SSDs:

Langer Kontext Überlaufspeicher: Wenn der KV-Cache die Speicherkapazität übersteigt, werden SSDs mit niedriger Latenz und hoher Speicherkapazität (wie pSLC-Modus, NVMe 4.0/5.0) zum idealen sekundären Cache, was die Nachfrage nach Leistung und Kapazität von SSDs der Unternehmensklasse deutlich erhöht.

Erweiterung der Vektordatenbank: Die zunehmende Verbreitung von RAG-Systemen (Retrieval-Augmented Generation), die durch TurboQuant vorangetrieben wird, wird das Wachstum von Vektordatenbanken, die in hohem Maße auf Hochleistungs-SSDs für die zugrunde liegende Speicherung angewiesen sind, direkt fördern.

Edge AI-Einsatz: TurboQuant ermöglicht die Ausführung von KI-Modellen auf Geräten der Verbraucherklasse, wodurch der Markt für Client-seitige SSDs erweitert wird und insbesondere die Nachfrage nach stromsparenden, leistungsstarken M.2 SSDs.

Die Panik auf dem Markt bezüglich HBM scheint übertrieben zu sein:

Klare Unterscheidung zwischen Training und Inferenz: TurboQuant beeinflusst nur den KV-Cache während der Inferenz. Die Bandbreitenanforderungen für die Modellschulung auf HBM bleiben unvermindert bestehen; HBM ist nach wie vor eine wesentliche Voraussetzung für die Schulung ultragroßer Modelle.

Modellgewicht Lagerung unberührt: Modellgewichte, die über 90% des AI-Speicherverbrauchs ausmachen, werden von TurboQuant nicht komprimiert. Die Rolle des HBM als primäres Medium für die Speicherung dieser Gewichte bleibt gesichert.

Optimierung der hybriden Architektur: TurboQuant ermöglicht eine effizientere Zuweisung von HBM-Ressourcen für kritische Rechenaufgaben und fördert die Entwicklung von hybriden Speicherarchitekturen, die HBM, DDR und SSD kombinieren, anstatt sie einfach zu ersetzen.

Potenzielles neues Paradigma für die KI-Infrastruktur

Der eigentliche Wert von TurboQuant liegt nicht in der “Eliminierung” eines bestimmten Speichertyps, sondern in der Neugestaltung der Storage-Tiering-Architektur der KI-Infrastruktur, wodurch eine effizientere und wirtschaftlichere Speicherhierarchie geschaffen wird.

Eine neue Ordnung des intelligenten Datenflusses

Künftige Speicherarchitekturen für KI-Server werden wahrscheinlich eine klare dreistufige Pyramide aufweisen:

Höchste Stufe - HBM: Verantwortlich für die Speicherung zentraler Rechendaten wie Modellgewichte und Aktivierungen, die den bandbreitenintensiven Anforderungen von Trainings- und Inferenzaufgaben entsprechen.

Mittlere Ebene - DDR: Dient als primärer Träger für den KV-Cache. Dank der Komprimierungseffizienz von TurboQuant wird DDR5/DDR6 zum Arbeitsspeicher für Inferenzszenarien.

Unterste Ebene - SSD: Handhabung von langen Kontextüberläufen, Vektordatenbanken und Modellprüfpunkten. Unternehmens-SSDs mit niedriger Latenz und hoher Ausfallsicherheit werden neue Wachstumsmöglichkeiten bieten.

Der Kern dieser mehrstufigen Architektur ist intelligente Datenplatzierung - dynamisches Verschieben von Daten zwischen den Ebenen auf der Grundlage der Zugriffshäufigkeit, der Latenzanforderungen und der Speicherkosten, um ein optimales Verhältnis zwischen Leistung und Kosten zu erreichen.

Der Aufstieg der Software-definierten Speicherung

TurboQuant kann die Einführung von Software-definierter Speicher (SDS) in der KI, insbesondere in den folgenden Bereichen:

Speicherverwaltungssysteme: Verwaltungssoftware, die die Größe des KV-Cache in Echtzeit überwachen und intelligent entscheiden kann, ob Daten im HBM, DDR oder auf SSDs gespeichert werden sollen, wird eine Standardkomponente der KI-Infrastruktur werden.

CXL-Speicher-Pooling: Durch das Pooling von DDR-Speicherressourcen mehrerer Server über das CXL-Protokoll werden elastisch skalierbare Speicherressourcen für KI-Cluster bereitgestellt, wodurch der HBM-Kapazitätsbedarf pro einzelnem Server weiter reduziert wird.

Komprimierungsfähiger Speicher: Speichergeräte werden von Haus aus Komprimierungsalgorithmen wie TurboQuant unterstützen, die eine schnelle Datenkomprimierung und -dekomprimierung auf Hardware-Ebene ermöglichen und so die Effizienz des Gesamtsystems verbessern.

Die Veröffentlichung von TurboQuant ist kein Omen für den Untergang der Speicherindustrie, sondern eher ein neuer Ausgangspunkt für eine tiefere Integration von Speicherung und KI. Es wird nicht einfach eine bestimmte Art von Speicherprodukten “eliminieren”. Vielmehr wird sie durch einen revolutionären Durchbruch in der Komprimierungstechnologie die Speicherindustrie zu mehr Effizienz und Intelligenz führen. Das bedeutet, dass künftige KI-Dienste in der Lage sein werden, längere Texte zu verarbeiten, präzisere Antworten zu geben und dabei möglicherweise die Hardwarekosten zu senken. Bei einer echten technologischen Revolution geht es nie um einen einfachen Ersatz, sondern darum, durch Innovation einen Effizienzsprung bei der Ressourcennutzung zu erreichen und damit die Türen zu breiteren Anwendungen zu öffnen.