Em 24 de março de 2026, a Google Research revelou oficialmente TurboQuant - uma tecnologia de compressão de IA inovadora que comprime a cache de valores-chave (KV Cache) utilizada durante a inferência de modelos de linguagem de grande dimensão até 3 bits precisão. Desta forma, obtém-se uma Redução de 6x na utilização da memória e até um Aumento de 8x na velocidade de inferênciasem qualquer perda de precisão do modelo. O anúncio desencadeou uma volatilidade imediata no mercado global de chips de memória, com o preço das acções da Micron Technology a cair a pique e os principais intervenientes, como a Samsung e a SK Hynix, a sofrerem também, perdendo coletivamente mais de $90 mil milhões em valor de mercado. O que torna esta tecnologia tão poderosa? Será que vai realmente perturbar o sector do armazenamento? Como é que produtos de armazenamento como o SSDs, DDR, e HBM evoluir?

O que é o TurboQuant?

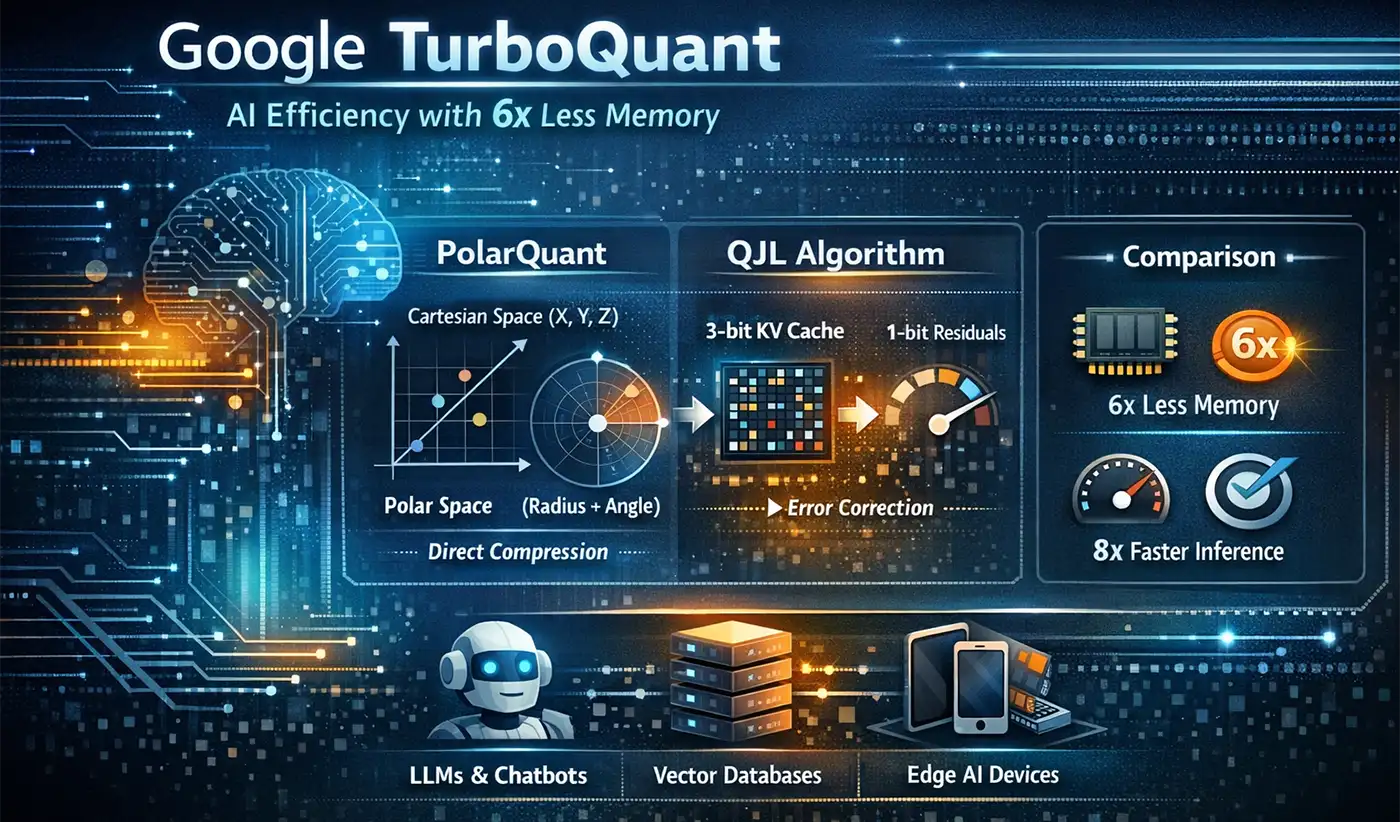

TurboQuant é um algoritmo de quantização vetorial em linha sem formação e sem enviesamento de dados desenvolvido pela Google Research. Foi especificamente concebido para comprimir agressivamente o cache de valores-chave (KV Cache) durante a inferência de modelos linguísticos de grande dimensão.

A cache KV é uma estrutura de dados temporária que armazena informações de contexto durante a inferência do modelo. Cresce continuamente com conversas mais longas, tornando-se um estrangulamento crítico que limita a capacidade de um modelo para lidar com sequências de texto longas. Os métodos de compressão tradicionais requerem frequentemente a reciclagem do modelo, grandes conjuntos de dados de calibração ou armazenamento adicional para parâmetros de quantização. A inovação do TurboQuant reside na sua capacidade de obter uma compressão sem perdas de 16/32 bits para 3 bits sem quaisquer ajustes de modelos, dados de treino ou sobrecarga de memória adicional - uma verdadeira solução "plug-and-play".

Arquitetura de compressão em duas fases

A principal inovação da TurboQuant é a sua estrutura de compressão em duas fasesque utiliza transformações matemáticas em vez de quantização de força bruta para alcançar um equilíbrio ideal entre eficiência e precisão:

PolarQuant: Esta é a principal fase de compressão, que transforma vectores de alta dimensão de coordenadas cartesianas para coordenadas polares. Começa por aplicar uma rotação aleatória aos vectores de entrada para tornar a distribuição dos dados mais uniforme. Em seguida, decompõe cada vetor em raio (representando a magnitude) e ângulo (representando a direção semântica), quantizando apenas o ângulo. Este processo elimina completamente a necessidade de armazenar parâmetros de normalização exigidos pelos métodos tradicionais.

QJL (Transformada Quantizada de Johnson-Lindenstrauss): Esta é a fase de correção residual. Utiliza 1 bit (bit de sinal) para aplicar uma correção não enviesada aos pequenos erros introduzidos durante a fase PolarQuant, assegurando que a precisão do cálculo da atenção não é comprometida. Esta etapa resolve o problema de acumulação de erros encontrado nos métodos de compressão tradicionais, tornando perda de precisão zero teoricamente possível.

Esta combinação de "compressão principal agressiva + correção residual não enviesada" permite ao TurboQuant atingir um desempenho de Precisão de 3 bits que iguala ou excede mesmo as linhas de base de precisão total, um facto validado por padrões de referência como o LongBench.

Principais caraterísticas e vantagens

O TurboQuant destaca-se entre as técnicas de compressão devido a quatro vantagens principais:

Não é necessária formação ou afinação: Pode ser aplicado diretamente aos modelos existentes (Llama, Mistral, Gemma, Gemini, etc.) sem qualquer ajustamento ou reciclagem, o que permite uma implantação imediata.

Dados imparciais: O seu desempenho é independente da distribuição dos dados de entrada, funcionando eficazmente em todos os tipos de dados de texto, código e imagem, sem necessidade de otimização específica do cenário.

Zero despesas gerais: Não requer armazenamento adicional para parâmetros de quantização, factores de normalização, etc., o que contrasta fortemente com os métodos tradicionais.

Teoricamente ótimo: Oferece garantias de distorção matematicamente quase óptimas, proporcionando uma previsibilidade fiável do desempenho para uma implantação em grande escala.

Nuvem sobre o Halo: uma breve nota sobre a controvérsia académica

A par das ondas de choque no mercado causadas pela TurboQuant, surgiu uma disputa académica. A 27 de março, Jianyang Gao, pós-doutorado na ETH de Zurique, alegou publicamente que a metodologia principal da TurboQuant é muito semelhante à da RaBitQ, um algoritmo que publicou em 2024 na SIGMOD. Gao salientou que o artigo da equipa da Google evitava discutir semelhanças metodológicas, depreciava os resultados teóricos do RaBitQ como "subóptimos" sem justificação e utilizava comparações experimentais injustas (testando o RaBitQ numa CPU de núcleo único enquanto testava o TurboQuant numa GPU A100).

De acordo com Gao, estes problemas foram comunicados à equipa da Google por correio eletrónico antes da publicação do documento. Embora a equipa da Google tenha reconhecido alguns problemas, apenas prometeu fazer correcções após a conferência e negou as semelhanças técnicas. Em 31 de março, a equipa do RaBitQ tinha publicou um comentário público no ICLR OpenReview e apresentou uma queixa formal ao comité de ética da conferência do ICLR. Esta controvérsia serve como um lembrete: O valor técnico do TurboQuant ainda precisa de tempo para ser totalmente validado e as questões de conduta académica envolvidas são igualmente dignas de nota.

Impacto potencial no sector do armazenamento

Um olhar racional sobre a reação do mercado

A queda acentuada dos stocks de chips de armazenamento após o anúncio da TurboQuant foi mais uma reação exagerada impulsionada pelo sentimento do mercado do que uma avaliação racional. Para compreender o verdadeiro impacto, é fundamental definir primeiro o conceito de âmbito de influência:

Afecta apenas a inferência: Não tem impacto no processo de treinamento do modelo, que é o cenário de demanda principal para a memória de ponta como a HBM.

Comprime apenas a cache KV: Os pesos do modelo, as activações e outros dados principais não são afectados. Estes representam os principais consumidores de recursos de armazenamento.

O paradoxo dos ganhos de eficiência: A experiência histórica sugere que as melhorias na eficiência computacional conduzem frequentemente a aplicações de maior escala, potencialmente crescente a procura global de armazenagem em vez de a diminuir (paradoxo de Jevons).

Impactos potenciais em SSD, DDR e HBM

O TurboQuant pode ter uma memória DDR de duplo impacto. Por um lado, reduz a dependência do HBM, permitindo que o cache KV seja armazenado de forma mais económica em DDR5/DDR6 em vez de exigir o caro HBM. Isso cria novas oportunidades para DDR5-8800+ de alta largura de banda e futura DDR6posicionando-os como uma alternativa económica ao HBM em servidores de IA. Por outro lado, o TurboQuant acelera a adoção da tecnologia de expansão de memória CXL. Ao agrupar a memória DDR via CXL, os servidores de IA podem alocar recursos de memória de forma mais flexível para lidar com tarefas de inferência de tamanhos variados, aumentando ainda mais a eficiência da utilização de DDR e a demanda do mercado.

Ao contrário das preocupações do mercado, o TurboQuant é provavelmente um desenvolvimento positivo significativo para os SSDs:

Armazenamento de transbordo de contexto longo: Quando a cache KV excede a capacidade da memória, as SSDs de baixa latência e alta resistência (como o modo pSLC, NVMe 4.0/5.0) tornam-se a cache secundária ideal, aumentando significativamente a procura de desempenho e capacidade das SSDs de nível empresarial.

Expansão da Base de Dados Vetorial: A crescente adoção de sistemas RAG (Retrieval-Augmented Generation), impulsionada pelo TurboQuant, irá alimentar diretamente o crescimento das bases de dados vectoriais, que dependem fortemente de SSDs de elevado desempenho para o seu armazenamento subjacente.

Implementação da IA de ponta: O TurboQuant torna possível executar modelos de IA em dispositivos de consumo, expandindo o mercado de SSDs do lado do cliente, aumentando particularmente a demanda por baixo consumo de energia e alto desempenho SSDs M.2.

O pânico do mercado em relação à HBM parece ter sido exagerado:

Distinção clara entre formação e inferência: TurboQuant só afeta o cache KV durante a inferência. As exigências de largura de banda para o treinamento de modelos no HBM permanecem inalteradas; o HBM continua sendo um requisito essencial para o treinamento de modelos de escala ultra-grande.

Armazenamento do peso do modelo não afetado: Os pesos dos modelos, que representam mais de 90% do consumo de memória da IA, não são comprimidos pelo TurboQuant. O papel do HBM como o principal meio de armazenamento desses pesos permanece seguro.

Otimização da arquitetura híbrida: O TurboQuant permite que os recursos HBM sejam alocados de forma mais eficiente para tarefas críticas de computação, promovendo o desenvolvimento de arquiteturas de armazenamento híbridas que combinam HBM, DDR e SSD, em vez de uma simples substituição.

Potencial novo paradigma para a infraestrutura de IA

O verdadeiro valor do TurboQuant não reside na "eliminação" de um tipo específico de armazenamento, mas na reformulação da arquitetura de armazenamento em camadas da infraestrutura de IA, conduzindo à criação de uma hierarquia de armazenamento de memória mais eficiente e económica.

Uma nova ordem de fluxo de dados inteligente

É provável que as futuras arquitecturas de armazenamento de servidores de IA apresentem uma clara pirâmide de três níveis:

Top Tier - HBM: Responsável pelo armazenamento de dados computacionais essenciais, como pesos e activações de modelos, satisfazendo as exigências de largura de banda intensiva das tarefas de formação e inferência.

Nível intermédio - DDR: Actua como o suporte principal para a cache KV. Beneficiando da eficiência de compressão do TurboQuant, a DDR5/DDR6 tornar-se-á a memória de trabalho para cenários de inferência.

Escalão inferior - SSD: Lida com transbordamento de contexto longo, bases de dados vectoriais e pontos de verificação de modelos. As SSDs empresariais de baixa latência e alta resistência encontrarão novas oportunidades de crescimento.

O núcleo desta arquitetura em camadas é colocação inteligente de dados - movendo dinamicamente os dados entre camadas com base na frequência de acesso, nos requisitos de latência e no custo de armazenamento para alcançar o equilíbrio ideal entre desempenho e custo.

A ascensão do armazenamento definido por software

A TurboQuant pode acelerar a adoção de Armazenamento definido por software (SDS) na IA, nomeadamente nos seguintes domínios:

Sistemas de gestão de memória: O software de gerenciamento que pode monitorar o tamanho do cache KV em tempo real e decidir de forma inteligente se os dados devem ser mantidos no HBM, DDR ou transbordados para SSDs se tornará um componente padrão da infraestrutura de IA.

Pooling de memória CXL: O agrupamento de recursos de memória DDR de vários servidores através do protocolo CXL fornecerá recursos de memória elasticamente escaláveis para clusters de IA, reduzindo ainda mais o requisito de capacidade HBM por servidor individual.

Armazenamento com capacidade de compressão: Os dispositivos de armazenamento começarão a suportar nativamente algoritmos de compressão como o TurboQuant, permitindo a rápida compressão e descompressão de dados ao nível do hardware para melhorar a eficiência geral do sistema.

O lançamento do TurboQuant não é um presságio de desgraça para a indústria de armazenamento, mas sim um novo ponto de partida para uma integração mais profunda entre o armazenamento e a IA. Não irá simplesmente "eliminar" um determinado tipo de produto de armazenamento. Em vez disso, através de um avanço revolucionário na tecnologia de compressão, conduzirá a indústria do armazenamento para uma maior eficiência e inteligência. Isto significa que os futuros serviços de IA serão capazes de lidar com textos mais longos, fornecendo respostas mais precisas e reduzindo potencialmente os custos de hardware. A verdadeira revolução tecnológica nunca tem a ver com uma simples substituição, mas sim com um salto na eficiência da utilização de recursos através da inovação, abrindo assim portas a aplicações mais vastas.