Il 24 marzo 2026, Google Research ha presentato ufficialmente TurboQuant - una tecnologia di compressione AI dirompente che comprime la cache key-value (KV Cache) utilizzata durante l'inferenza di modelli linguistici di grandi dimensioni fino a 3-bit precisione. In questo modo si ottiene un Riduzione di 6 volte dell'utilizzo della memoria e fino a un Aumento di 8 volte della velocità di inferenza, Il tutto senza alcuna perdita di precisione del modello. L'annuncio ha scatenato un'immediata volatilità nel mercato globale dei chip di memoria, con il crollo del prezzo delle azioni di Micron Technology e la perdita di oltre $90 miliardi di valore di mercato da parte di importanti operatori come Samsung e SK Hynix. Cosa rende questa tecnologia così potente? Riuscirà a sconvolgere il settore dell'archiviazione? In che modo i prodotti di archiviazione come SSD, DDR e HBM evolversi?

Che cos'è TurboQuant?

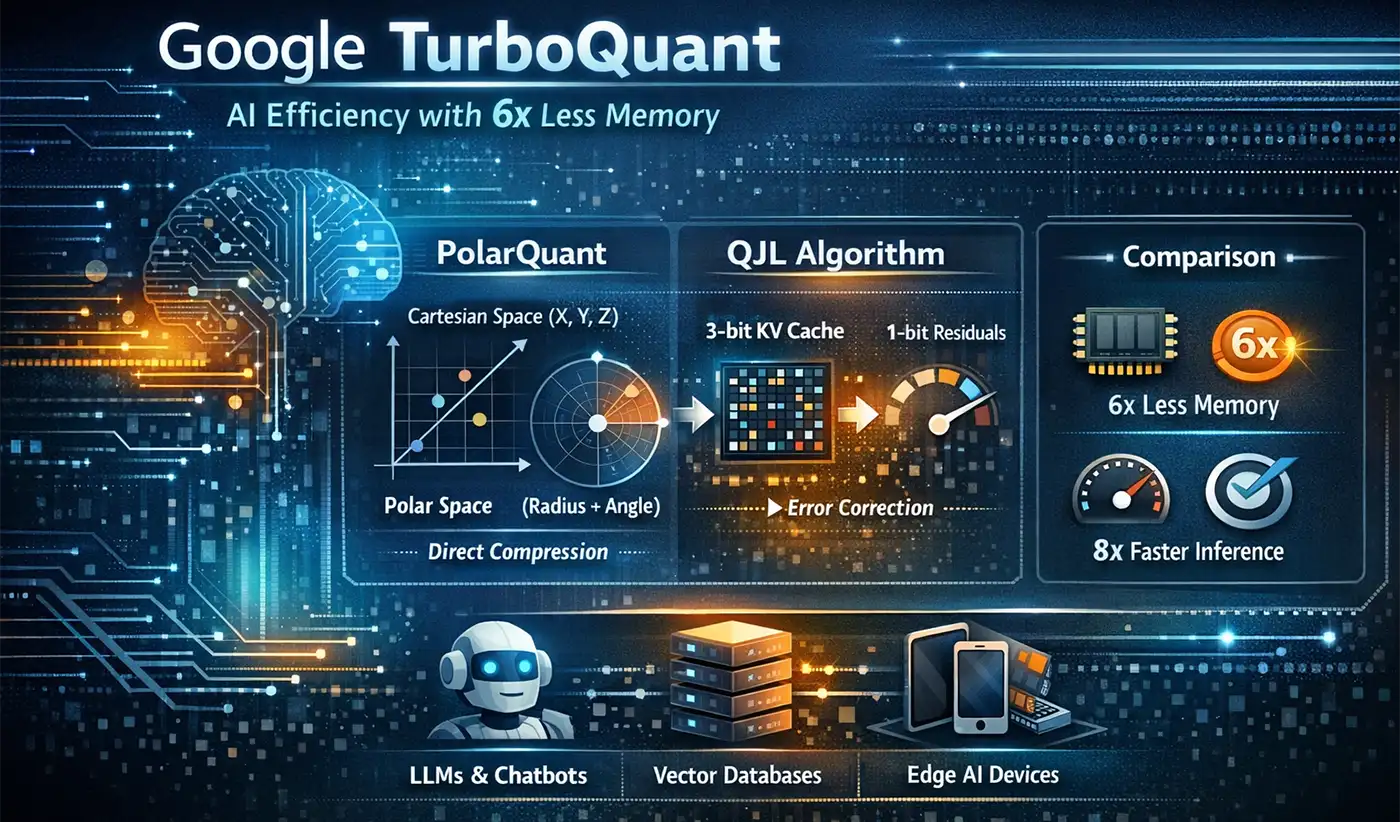

TurboQuant è un algoritmo di quantizzazione vettoriale online, privo di addestramento e non condizionato dai dati sviluppato da Google Research. È stato progettato specificamente per comprimere in modo aggressivo il cache chiave-valore (KV Cache) durante l'inferenza di modelli linguistici di grandi dimensioni.

La KV Cache è una struttura dati temporanea che memorizza le informazioni sul contesto durante l'inferenza del modello. Cresce continuamente con le conversazioni più lunghe, diventando un collo di bottiglia critico che limita la capacità di un modello di gestire lunghe sequenze di testo. I metodi di compressione tradizionali spesso richiedono una riqualificazione del modello, grandi set di dati di calibrazione o una memorizzazione aggiuntiva per i parametri di quantizzazione. Il punto di forza di TurboQuant è la capacità di ottenere una compressione senza perdite da 16/32 bit a 3 bit. senza dover modificare il modello, senza dover utilizzare dati di addestramento o memoria aggiuntiva: una vera e propria soluzione “plug-and-play”.

Architettura di compressione a due fasi

L'innovazione principale di TurboQuant è il suo struttura di compressione a due fasi, che utilizza trasformazioni matematiche anziché la quantizzazione a forza bruta per ottenere un equilibrio ideale tra efficienza e precisione:

PolarQuant: È la fase principale di compressione, che trasforma i vettori ad alta dimensione da coordinate cartesiane a coordinate polari. Per prima cosa applica una rotazione casuale ai vettori in ingresso per rendere più uniforme la distribuzione dei dati. Quindi decompone ogni vettore in raggio (che rappresenta la magnitudo) e angolo (che rappresenta la direzione semantica), quantizzando solo l'angolo. Questo processo elimina completamente la necessità di memorizzare i parametri di normalizzazione richiesti dai metodi tradizionali.

QJL (Trasformata di Johnson-Lindenstrauss quantizzata): È la fase di correzione dei residui. Utilizza 1 bit (bit di segno) per applicare una correzione imparziale ai piccoli errori introdotti durante la fase PolarQuant, garantendo che l'accuratezza del calcolo dell'attenzione non venga compromessa. Questo passaggio risolve il problema dell'accumulo di errori che si riscontra nei metodi di compressione tradizionali, rendendo perdita di precisione zero teoricamente possibile.

Questa combinazione di “compressione principale aggressiva + correzione del residuo non distorta” consente a TurboQuant di raggiungere prestazioni pari a Precisione a 3 bit che eguaglia o addirittura supera le linee di base a piena precisione, un fatto convalidato da benchmark standard come LongBench.

Caratteristiche e vantaggi principali

TurboQuant si distingue tra le tecniche di compressione grazie a quattro vantaggi fondamentali:

Non è necessaria alcuna formazione o messa a punto: Può essere applicato direttamente ai modelli esistenti (Llama, Mistral, Gemma, Gemini, ecc.) senza alcuna modifica o riqualificazione, consentendone l'impiego immediato.

Dati imparziali: Le sue prestazioni sono indipendenti dalla distribuzione dei dati in ingresso e funzionano efficacemente su tutti i tipi di testo, codice e immagini, senza bisogno di ottimizzazioni specifiche per ogni scenario.

Zero spese generali: Non richiede alcuna memorizzazione aggiuntiva per i parametri di quantizzazione, i fattori di normalizzazione e così via, in netto contrasto con i metodi tradizionali.

Teoricamente ottimale: Offre garanzie di distorsione matematicamente quasi ottimali, fornendo una prevedibilità delle prestazioni affidabile per l'implementazione su larga scala.

Nuvola sopra l'aureola: una breve nota sulla controversia accademica

Accanto alle scosse di mercato causate da TurboQuant, è emersa una controversia accademica. Il 27 marzo Jianyang Gao, borsista post-dottorato presso il Politecnico di Zurigo, ha affermato pubblicamente che la metodologia di base di TurboQuant è molto simile a quella di RaBitQ, un algoritmo che ha pubblicato nel 2024 al SIGMOD. Gao ha sottolineato che l'articolo del team di Google evitava di discutere le somiglianze metodologiche, denigrava i risultati teorici di RaBitQ come “subottimali” senza alcuna giustificazione e utilizzava confronti sperimentali scorretti (testando RaBitQ su una CPU single-core e TurboQuant su una GPU A100).

Secondo Gao, questi problemi sono stati comunicati al team di Google via e-mail prima della pubblicazione del documento. Sebbene il team di Google abbia riconosciuto alcuni problemi, ha promesso di apportare correzioni solo dopo la conferenza e ha negato le somiglianze tecniche. Al 31 marzo, il team di RaBitQ ha inviato un commento pubblico su ICLR OpenReview e ha presentato un reclamo formale al comitato etico della conferenza dell'ICLR. Questa controversia serve come promemoria: Il valore tecnico di TurboQuant richiede ancora tempo per essere pienamente convalidato, e i problemi di condotta accademica coinvolti sono altrettanto degni di nota.

Impatto potenziale sul settore dello stoccaggio

Uno sguardo razionale alla reazione del mercato

Il forte calo dei titoli dei chip di archiviazione in seguito all'annuncio di TurboQuant è stato più che altro una reazione eccessiva guidata dal sentimento di mercato di una valutazione razionale. Per comprendere il vero impatto, è fondamentale definire prima il concetto di TurboQuant. ambito di influenza:

Influenza solo l'inferenza: Non ha alcun impatto sul processo di addestramento dei modelli, che è lo scenario principale della domanda di memorie di fascia alta come le HBM.

Comprime solo la cache KV: I pesi del modello, le attivazioni e gli altri dati fondamentali non sono interessati. Questi rappresentano i principali consumatori di risorse di memoria.

Il paradosso dei guadagni di efficienza: L'esperienza storica suggerisce che i miglioramenti nell'efficienza computazionale spesso portano ad applicazioni su scala più ampia, potenzialmente in aumento domanda complessiva di stoccaggio anziché diminuirla (paradosso di Jevons).

Impatto potenziale su SSD, DDR e HBM

TurboQuant può avere una memoria DDR a doppio impatto. Da un lato, riduce la dipendenza da HBM consentendo di memorizzare la KV Cache in modo più economico in DDR5/DDR6 invece di richiedere la costosa HBM. Ciò crea nuove opportunità per le DDR5-8800+ ad alta larghezza di banda e le futuro DDR6, posizionandole come un'alternativa economicamente vantaggiosa alla HBM nei server AI. D'altra parte, TurboQuant accelera l'adozione della tecnologia di espansione della memoria CXL. Grazie al pooling della memoria DDR tramite CXL, i server AI possono allocare le risorse di memoria in modo più flessibile per gestire compiti di inferenza di dimensioni diverse, migliorando ulteriormente l'efficienza di utilizzo della DDR e la domanda di mercato.

Contrariamente alle preoccupazioni del mercato, TurboQuant rappresenta probabilmente un significativo sviluppo positivo per le unità SSD:

Stoccaggio in eccesso del contesto lungo: Quando la KV Cache supera la capacità della memoria, le unità SSD a bassa latenza e ad alta resistenza (come la modalità pSLC, NVMe 4.0/5.0) diventano la cache secondaria ideale, aumentando in modo significativo la domanda di prestazioni e capacità delle unità SSD di livello aziendale.

Espansione del database vettoriale: La maggiore adozione di sistemi RAG (Retrieval-Augmented Generation), guidata da TurboQuant, alimenterà direttamente la crescita dei database vettoriali, che si basano in larga misura su SSD ad alte prestazioni per lo storage sottostante.

Implementazione dell'intelligenza artificiale sui bordi: TurboQuant rende possibile l'esecuzione di modelli di intelligenza artificiale su dispositivi di fascia consumer, espandendo il mercato delle unità SSD lato client e aumentando in particolare la domanda di dispositivi a basso consumo e ad alte prestazioni. SSD M.2.

Il panico del mercato nei confronti delle HBM sembra esagerato:

Chiara distinzione tra formazione e inferenza: TurboQuant influenza solo la KV Cache durante l'inferenza. I requisiti di larghezza di banda per l'addestramento dei modelli su HBM rimangono invariati; HBM rimane un requisito essenziale per l'addestramento di modelli su scala ultra-grande.

Peso del modello Conservazione inalterata: I pesi del modello, che rappresentano oltre 90% del consumo di memoria dell'IA, non vengono compressi da TurboQuant. Il ruolo della HBM come mezzo primario per la memorizzazione di questi pesi rimane sicuro.

Ottimizzazione dell'architettura ibrida: TurboQuant consente di allocare le risorse HBM in modo più efficiente ai compiti di calcolo critici, promuovendo lo sviluppo di architetture di storage ibride che combinano HBM, DDR e SSD, piuttosto che la semplice sostituzione.

Un potenziale nuovo paradigma per l'infrastruttura di IA

Il vero valore di TurboQuant non risiede nell“”eliminazione" di un tipo specifico di storage, ma nel ridisegnare l'architettura di storage tiering dell'infrastruttura AI, guidando la creazione di una gerarchia memoria-storage più efficiente ed economica.

Un nuovo ordine di flussi di dati intelligenti

Le future architetture di storage dei server AI saranno probabilmente caratterizzate da una chiara piramide a tre livelli:

Top Tier - HBM: È responsabile dell'archiviazione dei dati computazionali fondamentali, come i pesi e le attivazioni del modello, soddisfacendo le esigenze di larghezza di banda delle attività di addestramento e inferenza.

Livello intermedio - DDR: Funge da vettore primario per la cache KV. Beneficiando dell'efficienza di compressione di TurboQuant, le DDR5/DDR6 diventeranno la soluzione ideale per la cache KV. memoria del cavallo di battaglia per gli scenari di inferenza.

Livello inferiore - SSD: Gestisce l'overflow dei contesti lunghi, i database vettoriali e i checkpoint dei modelli. Le unità SSD aziendali a bassa latenza e ad alta resistenza offriranno nuove opportunità di crescita.

Il cuore di questa architettura a livelli è posizionamento intelligente dei dati - spostare dinamicamente i dati tra i livelli in base alla frequenza di accesso, ai requisiti di latenza e al costo dello storage per ottenere un equilibrio ottimale tra prestazioni e costi.

L'ascesa dello storage definito dal software

TurboQuant può accelerare l'adozione di Storage definito dal software (SDS) nell'IA, in particolare nelle seguenti aree:

Sistemi di gestione della memoria: Il software di gestione in grado di monitorare le dimensioni della cache KV in tempo reale e di decidere in modo intelligente se conservare i dati in HBM, DDR o trasferirli su SSD diventerà un componente standard dell'infrastruttura AI.

Pooling di memoria CXL: Il pooling delle risorse di memoria DDR da più server tramite il protocollo CXL fornirà risorse di memoria elasticamente scalabili per i cluster di intelligenza artificiale, riducendo ulteriormente la capacità HBM richiesta per ogni singolo server.

Archiviazione consapevole della compressione: I dispositivi di archiviazione inizieranno a supportare nativamente algoritmi di compressione come TurboQuant, consentendo una rapida compressione e decompressione dei dati a livello hardware per migliorare l'efficienza complessiva del sistema.

Il rilascio di TurboQuant non è un presagio di sventura per l'industria dello storage, ma piuttosto una nuovo punto di partenza per una più profonda integrazione tra storage e AI. Non si limiterà a “eliminare” un certo tipo di prodotto di archiviazione. Al contrario, grazie a un'innovazione rivoluzionaria nella tecnologia di compressione, spingerà il settore dello storage verso una maggiore efficienza e intelligenza. Ciò significa che i futuri servizi di intelligenza artificiale saranno in grado di gestire testi più lunghi, fornendo risposte più precise e riducendo potenzialmente i costi dell'hardware. La vera rivoluzione tecnologica non è mai una semplice sostituzione, ma un salto di qualità nell'efficienza dell'utilizzo delle risorse attraverso l'innovazione, aprendo così le porte ad applicazioni più ampie.