En 2025, l'intelligence artificielle (IA) a dépassé le stade de l'expérimentation et du déploiement initial pour entrer dans une phase de large application et de déploiement industriel à grande échelle. Qu'il s'agisse de l'entraînement de modèles à très grande échelle ou de l'inférence à faible latence dans les applications commerciales, les scénarios d'utilisation de l'IA et les volumes de données augmentent de manière explosive. Cette vague de croissance ne transforme pas seulement la structure des ressources de calcul, mais remodèle aussi profondément le profil de la demande de la couche de stockage, en particulier en ce qui concerne le stockage des données. lecteurs à semi-conducteurs (SSD). En tant qu'élément clé de la lecture et de la persistance des données, les disques SSD ne sont plus seulement des modules passifs de "capacité" ; ils deviennent des éléments critiques de performance et d'intelligence au niveau du système.

Le contexte : Comment la montée en puissance de l'IA stimule la demande de stockage

Ces dernières années, la taille des modèles d'IA et les calculs nécessaires à leur formation ont connu une croissance fulgurante. Selon l'étude le rapport sur l'indice 2025 de l'IA Selon l'étude Stanford HAI, le calcul d'entraînement des modèles d'IA notables a doublé sur des périodes de temps de plus en plus courtes, et la taille des ensembles de données augmente également rapidement, ce qui signifie que l'entraînement d'un grand modèle d'IA nécessite désormais des ressources de stockage, de bande passante et de persistance exponentiellement plus importantes. Plus important encore, ces modèles à grande échelle sont passés des environnements de développement à un déploiement à grande échelle dans les entreprises et à des scénarios d'inférence en ligne, entraînant une demande réelle de systèmes de stockage à faible latence et à haute concordance.

Pour mettre les choses en perspective, l'entraînement en nuage nécessite des données brutes de l'ordre du pétaoctet et des centaines de téraoctets à des pétaoctets de poids de modèle, tandis que les scénarios d'inférence et de génération augmentée par extraction (RAG) introduisent des milliers de petites requêtes d'E/S aléatoires et des lectures simultanées élevées. Ces tendances posent aux disques SSD des défis qu'une simple augmentation de la capacité ne suffit pas à relever.

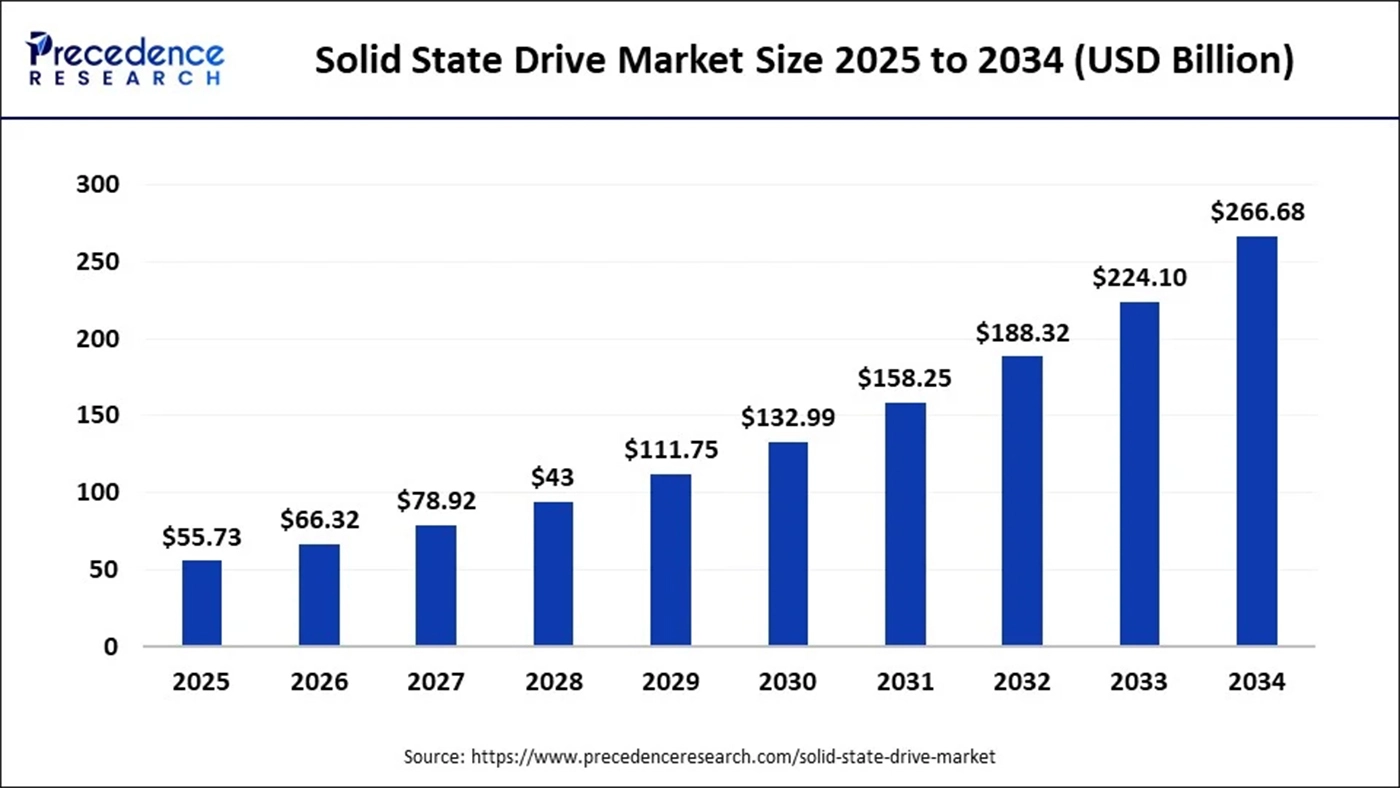

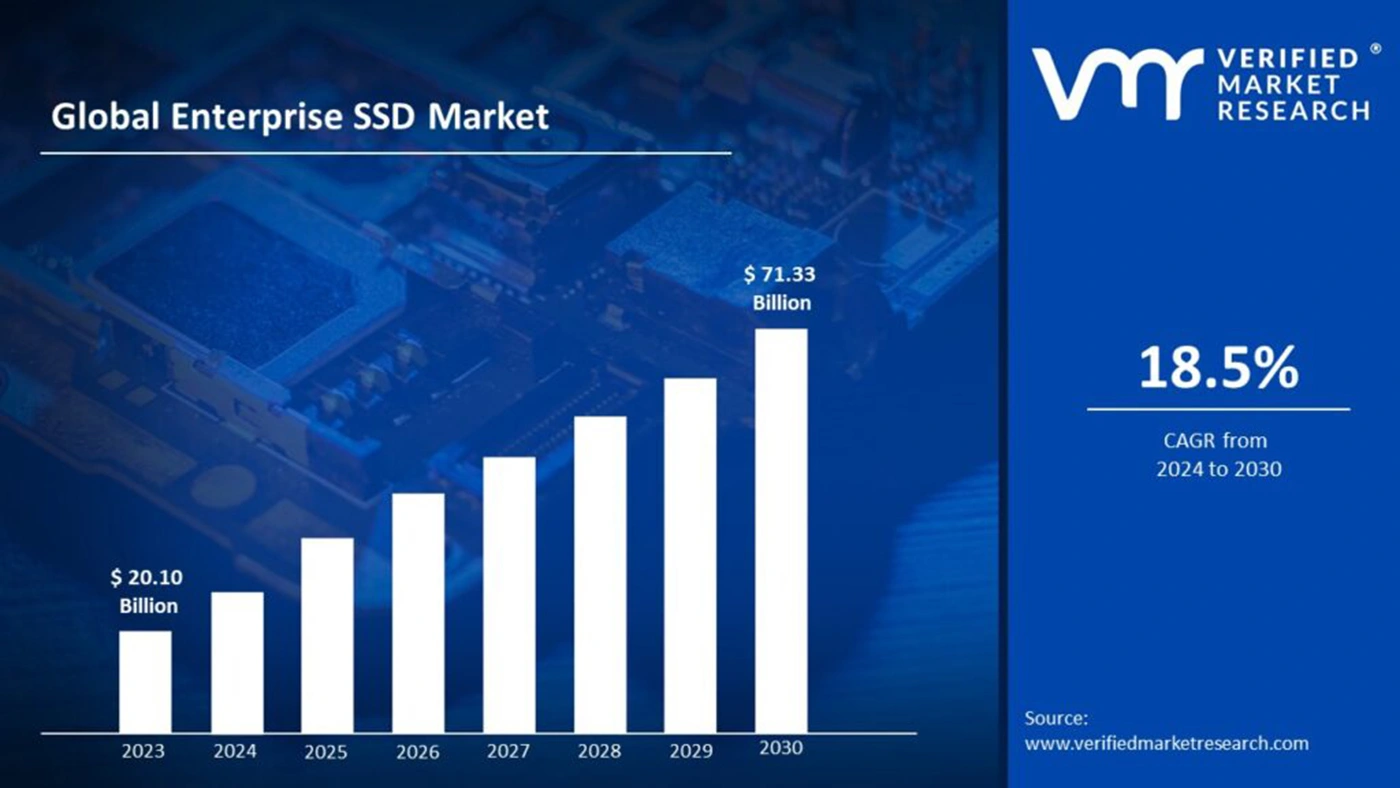

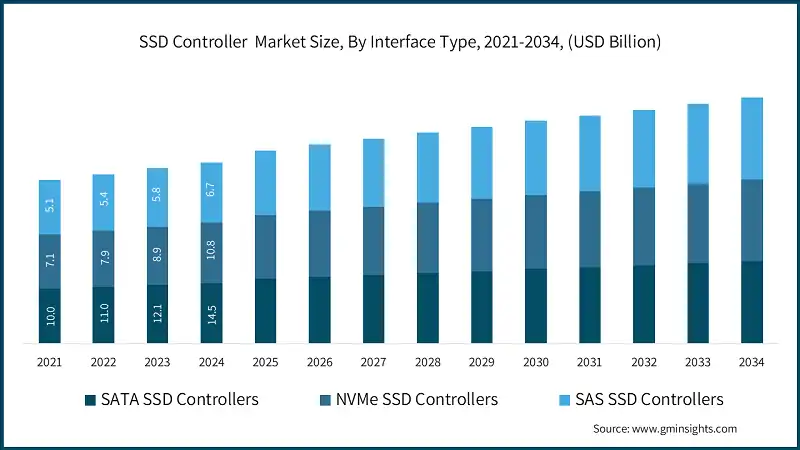

Par ailleurs, les prévisions des cabinets d'études de marché pour le marché des SSD considèrent l'IA comme l'un des principaux moteurs de la croissance. Par exemple, une prévision indique que la taille du marché mondial des SSD en 2025 est d'environ 55,73 milliards de dollarsavec des projections qui s'élèvent à environ 266,68 milliards d'USD d'ici à 2034.

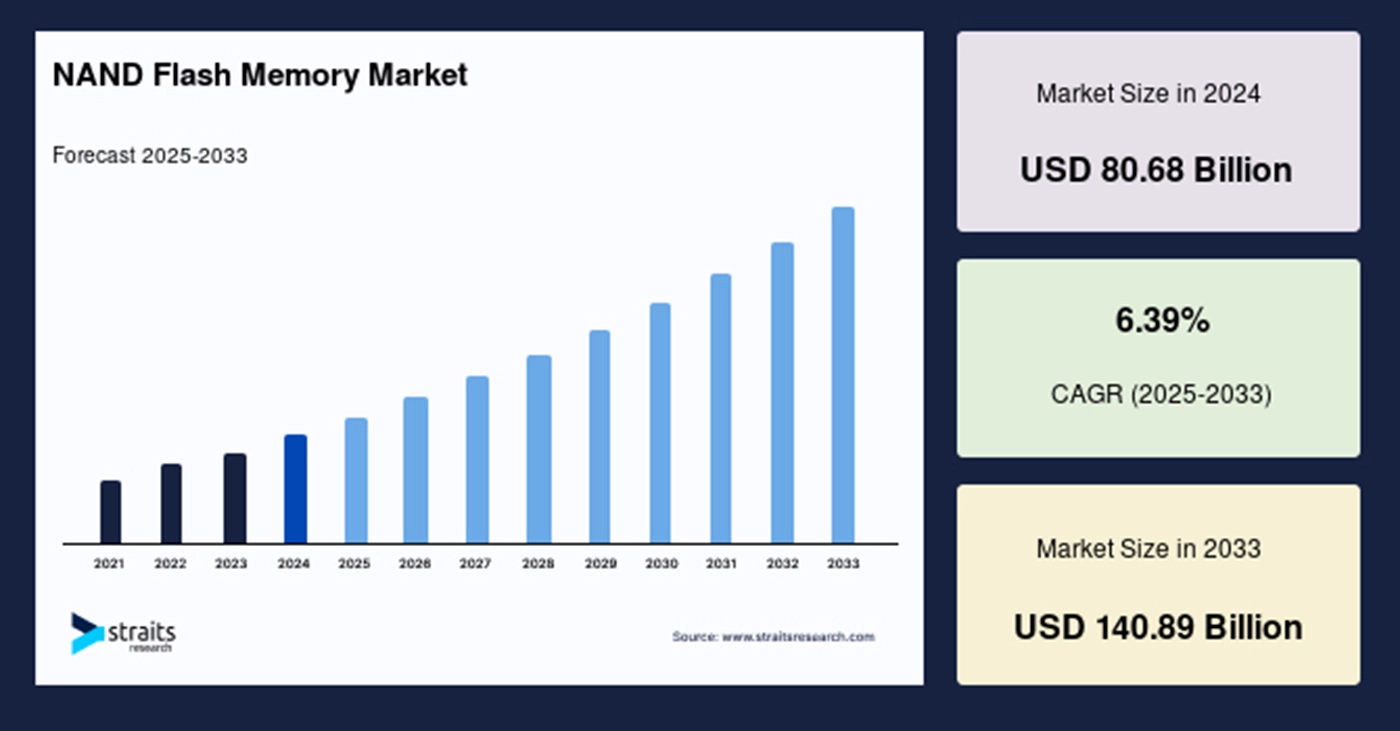

Cette croissance montre que l'IA augmente à la fois la demande de disques SSD haut de gamme et la demande de bits pour les disques SSD haut de gamme. Flash NAND en général, ce qui affecte la planification des capacités de la chaîne d'approvisionnement en amont et la fixation des prix.

Du côté de l'offre, les fournisseurs de mémoire sont de plus en plus conscients des exigences structurelles de l'IA en matière de Mémoire à grande largeur de bande (HBM)La demande de mémoires, de DRAM et de NAND. Par exemple, un grand fournisseur de mémoire a déclaré en 2025 que la demande de l'IA pour la mémoire HBM et d'autres types de mémoire est une variable de croissance clé, ce qui indique que les chaînes d'approvisionnement en mémoire et en NAND sont affectées par des projets d'IA qui peuvent être prioritaires.

En outre, l'écosystème de stockage autour de l'IA forme de nouvelles architectures de données et couches de services. Les bases de données vectorielles en tant qu'infrastructure de base pour la recherche et la recherche sémantique ont connu une croissance rapide en 2024-2025, et leur dépendance à l'égard du stockage en ligne (souvent des disques SSD NVMe) souligne l'importance croissante des disques SSD dans la pile de l'IA. Dans l'ensemble, la montée en puissance de l'IA n'augmente pas simplement la demande de " capacité ", elle accroît les exigences en matière de performances (débit, IOPS, latence), d'endurance (durabilité de l'écriture) et d'intelligence (microprogrammes et stockage informatisé).

Comment les charges de travail d'IA redéfinissent les mesures techniques des SSD

Traditionnellement, le choix d'un SSD est un compromis entre la capacité, le coût par Go et les performances de lecture/écriture séquentielles. Mais les charges de travail liées à l'intelligence artificielle imposent de nouvelles exigences qui rendent cette triade insuffisante.

Au cours de la phase de formation, la demande de stockage met l'accent sur une grande capacité et un débit séquentiel élevé, mais exige en même temps une bande passante parallèle très élevée et une capacité d'écriture persistante. Les flux de travail de formation impliquent de fréquentes écritures de points de contrôle, l'enregistrement distribué de tranches de modèles et le prétraitement massif de données d'échantillons, qui imposent tous de lourdes exigences en matière de débit d'écriture et d'endurance.

Dans les scénarios d'inférence en ligne et de RAG, les disques SSD sont confrontés à un ensemble différent de demandes. Ces scénarios impliquent généralement de nombreuses petites lectures aléatoires avec une très faible latence, en particulier lorsque les index vectoriels ou les embeddings sont partagés et que l'extraction génère des milliers de petites demandes d'E/S aléatoires simultanées. Une faible latence et un nombre élevé d'IOPS deviennent donc essentiels pour la réponse du système et l'expérience de l'utilisateur. Dans de nombreux déploiements réels, la mise en cache DRAM ne peut à elle seule couvrir l'ensemble des données de travail, ce qui fait que la mise en cache DRAM ne peut pas couvrir l'ensemble des données. Disques SSD NVMe Le SSD doit donc maintenir des performances élevées en lecture aléatoire tout en équilibrant le coût et la capacité.

En outre, dans le contexte du cycle de vie de l'IA, des pratiques telles que les points de contrôle incrémentiels, la mise au point des modèles et la synchronisation paramètre-serveur augmentent la fréquence des écritures et exacerbent l'amplification de l'écriture. Ainsi, les mesures d'endurance (par ex, TBW, DWPD) des disques SSD devient plus important que le simple débit brut. Les fournisseurs de SSD doivent adopter des algorithmes avancés de couche de traduction flash (FTL), des stratégies de collecte des déchets plus intelligentes et des mécanismes de consolidation d'écriture plus efficaces pour prolonger la durée de vie et maintenir les performances.

Du point de vue de l'architecture globale du système, les technologies d'interconnexion (par exemple PCIe 5.0/6.0, CXL) et les protocoles de stockage distribué (tels que NVMe-oF) deviennent l'épine dorsale reliant les disques SSD et les nœuds de calcul. Leur bande passante plus élevée et leur surcharge de communication plus faible rendent l'accès au stockage plus efficace dans les formations à grande échelle, ce qui pousse le rôle des disques SSD dans l'architecture : il ne s'agit plus d'un simple stockage de données statiques, mais d'un canal de données en temps réel étroitement couplé au calcul.

Cartes routières technologiques : Comment les disques SSD répondent aux nouveaux besoins de l'IA

En réponse à l'évolution de la demande, les fournisseurs de disques SSD et les architectes de systèmes suivent des orientations claires en matière de conception. Tout d'abord, les mises à niveau de l'interface et du protocole sont fondamentales. La norme PCIe 5.0 est déjà en cours d'adoption. PCIe 6.0 devrait être lancé progressivement au cours des prochaines années. Une largeur de bande de liaison plus élevée augmente directement le débit maximal disponible par lecteur et réduit la dépendance à l'égard de nombreux lecteurs parallèles, ce qui accroît la flexibilité de l'intégration du système.

En ce qui concerne le choix de la matrice NAND, les fournisseurs doivent mettre en balance le coût et les performances. QLC et les futures NAND à cellules multibits PLC, grâce à leur faible coût et à leur densité binaire plus élevée, sont bien adaptées au stockage de données froides ou "chaudes", permettant une rétention économique des données à grande échelle. Parallèlement, les types SLC/MLC - ou les matrices haut de gamme pour entreprises - restent essentiels pour les données chaudes nécessitant un nombre élevé d'IOPS et une longue durée de vie. De nombreux fournisseurs ajoutent donc des zones de cache DRAM ou SLC plus grandes dans les disques SSD et appliquent une hiérarchisation intelligente chaud/froid afin que le QLC puisse encore fonctionner de manière acceptable dans des scénarios avec des écritures aléatoires lourdes.

L'innovation en matière de contrôleurs et de microprogrammes devient encore plus cruciale. Les scénarios d'IA imposant des schémas d'E/S plus complexes, les contrôleurs traditionnels peuvent ne plus suffire. Les contrôleurs plus avancés peuvent effectuer une planification plus intelligente, intégrer l'accélération (par exemple, la compression/décompression, le préfiltrage sur disque) et mettre en œuvre des routines FTL plus complexes pour optimiser la consolidation des écritures et la collecte des déchets, réduisant ainsi l'amplification des écritures et améliorant l'endurance.

Une autre évolution notable est le "stockage computationnel", qui consiste à intégrer des unités de traitement spécialisées dans le disque SSD afin que certaines opérations de calcul (par exemple, l'extraction de caractéristiques, la vectorisation, le pré-filtrage) puissent se dérouler à proximité du stockage lui-même. Pour l'IA, cela signifie que les disques SSD eux-mêmes peuvent effectuer le filtrage initial ou la génération de l'intégration, réduisant ainsi le mouvement des données entre l'hôte et le stockage et améliorant l'efficacité de bout en bout. Si cette capacité est normalisée et que la prise en charge par l'écosystème logiciel arrive à maturité, elle pourrait profondément remodeler les pipelines d'IA à grande échelle.

Au-delà du matériel et des protocoles, la manière dont le stockage est intégré au niveau du système évolue également. Par exemple, le CXL (Compute Express Link) offre un moyen de coupler plus étroitement la mémoire et le stockage persistant, en rendant les ressources de mémoire ou de quasi-mémoire dynamiquement accessibles entre les nœuds, ce qui est important lors de l'entraînement de grands modèles d'intelligence artificielle avec d'énormes volumes de paramètres. Si le CXL est largement adopté, le positionnement et les caractéristiques requises des disques SSD pourraient changer ; dans certains cas, la mémoire persistante (PMEM) ou la mémoire de classe de stockage (SCM) pourraient devenir viables, mais en raison du coût et de la maturité de l'écosystème, les disques SSD NVMe devraient rester dominants dans un avenir prévisible.

Comment les bases de données vectorielles, le SDS et la gouvernance des données affectent l'utilisation des disques SSD

Le matériel pose les fondations, mais la clé reste la façon dont le logiciel exploite ce matériel pour servir les pipelines d'IA. Ces dernières années, les bases de données vectorielles, au cœur des scénarios de recherche sémantique et de RAG, ont connu une croissance fulgurante en 2024-2025. Ces bases de données adoptent généralement une architecture de stockage hiérarchisée "DRAM + NVMe SSD", conservant les vecteurs chauds en mémoire et les ensembles de vecteurs plus importants et proches de la ligne sur NVMe SSD afin d'équilibrer le coût et la réactivité. L'essor des bases de données vectorielles a directement augmenté l'importance des disques SSD NVMe dans les scénarios de récupération et a poussé les fournisseurs à optimiser les disques SSD pour la stabilité de la lecture aléatoire et la faible latence.

Dans le même temps, les fournisseurs de stockage défini par logiciel (SDS) proposent des services de stockage par blocs très performants dans des environnements de cloud computing et de cloud privé. Le SDS se distingue par sa capacité à orchestrer les ressources SSD sous-jacentes pour assurer la QoS (qualité de service), une mise à l'échelle élastique et une hiérarchisation plus fine des données chaudes/froides, ce qui est très utile pour les plateformes qui doivent gérer simultanément des charges de travail de formation et d'inférence tout en contrôlant les coûts.

Une autre dimension souvent négligée est la gouvernance des données et les outils de gestion des versions. Dans les flux de travail des modèles d'IA, les nombreux points de contrôle et versions des ensembles de données (par exemple, via DVC ou des outils similaires) génèrent des modèles d'écriture distincts. Il s'agit notamment d'écritures de snapshots périodiques, d'ensembles de données ramifiés et de journaux d'audit, qui entraînent tous des pics dans les charges d'écriture. Pour les fournisseurs de disques SSD et les architectes système, la modélisation de ces courbes d'écriture et la conception de stratégies de mise en cache correspondantes deviennent nécessaires pour garantir un fonctionnement stable du système sur le long terme.

Offre et demande et dynamique du marché

L'explosion de l'IA met à nouveau en lumière les ressources de mémoire et de stockage, ce qui pose des problèmes d'équilibre entre l'offre et la demande pour les mémoires flash NAND. Les rapports industriels et les articles de presse indiquent que les fournisseurs de mémoire en 2025 considèrent la demande de l'IA pour la mémoire HBM et d'autres types de mémoire comme une variable clé pour la croissance du chiffre d'affaires. Bien que la mémoire HBM soit plus directement destinée aux accélérateurs, la pression à la hausse sur la demande de mémoire et de NAND influence les structures de coûts et les délais de livraison des disques SSD.

Du point de vue du marché, les prévisions de revenus des SSD montrent des trajectoires positives et une part croissante pour les SSD d'entreprise et les SSD spécifiques à l'IA. Par exemple, une prévision estime la taille du marché des SSD à 55,73 milliards de dollars en 2025, pour atteindre 266,68 milliards de dollars en 2034.

Cependant, l'expansion des capacités est une activité à forte intensité de capital et prend du temps ; toute erreur d'estimation de la demande future peut conduire à une offre excédentaire ou à des pénuries, toutes deux à l'origine de fluctuations de prix. Ces incertitudes obligent les acteurs du secteur à adopter une planification plus prudente. Les risques liés à la chaîne d'approvisionnement mondiale compliquent encore la situation : les tensions géopolitiques, la volatilité des prix des matières premières et le rythme des investissements dans les équipements peuvent tous avoir un impact sur les cycles de lancement des produits SSD et sur les performances en matière de livraison. Les fournisseurs doivent trouver un équilibre entre les investissements en R&D et l'expansion des capacités : garantir l'adéquation future des produits aux scénarios d'IA tout en évitant le fardeau des stocks liés à la surcapacité.

Risques, défis et trois points de vigilance pour l'avenir

Lorsqu'il s'agit de prévoir les évolutions futures, il est essentiel de rester sensible aux incertitudes. Tout d'abord, les normes telles que CXL et PCIe 6.0 pourraient prendre plus de temps que prévu pour être largement adoptées ; si leur écosystème mûrit lentement, le découplage prévu entre mémoire et stockage pourrait être retardé. Deuxièmement, l'échelle de déploiement réelle du stockage informatique reste à voir ; de nombreux scénarios impliquent la migration de la logique de calcul vers les disques SSD, ce qui exige une prise en charge complète de la pile logicielle et une coordination de l'écosystème - ce que les fournisseurs de matériel ne peuvent pas faire seuls. Troisièmement, des technologies alternatives (telles que SCM, PMEM ou d'autres futures mémoires non volatiles) pourraient rattraper les solutions NAND actuelles en termes de coût ou de performance, ce qui modifierait les profils de la demande de SSD à long terme.

En outre, la consommation d'énergie et la durabilité deviendront de plus en plus importantes. La formation à grande échelle de modèles de classe GPT et les déploiements massifs de disques SSD peuvent augmenter considérablement la consommation d'énergie des centres de données. Au-delà de l'efficacité matérielle, l'industrie doit investir dans des mesures telles que la performance par watt et une planification plus intelligente pour répondre aux exigences réglementaires et aux exigences des entreprises en matière d'ESG.

Vue d'ensemble de la chronologie : Principales étapes et évolution du secteur

| Temps (3 prochaines années) | Événement ou tendance clé | Impact spécifique sur l'industrie des SSD |

|---|---|---|

| 2024-2025 | Croissance rapide de la formation de modèles à très grande échelle et commercialisation de bases de données vectorielles | Stimule la demande de disques SSD NVMe de grande capacité et d'appareils à haute IOPS ; à court terme, accélère l'expansion du marché des disques SSD d'entreprise. |

| 2025 | Augmentation de la demande de mémoire HBM et de mémoire à large bande passante ; les projets d'IA accordent la priorité à certaines capacités de mémoire | Les contraintes d'approvisionnement en mémoires et en puces haut de gamme peuvent indirectement augmenter les coûts des SSD et retarder les livraisons. |

| 2025-2026 | Déploiement plus large de PCIe 5.0 ; établissement progressif des écosystèmes PCIe 6.0 et CXL | Augmente la bande passante maximale par disque et permet un flux de données parallèle plus important ; prend en charge des architectures de stockage plus flexibles. |

| 2026-2027 | Essai et déploiement du stockage informatique et du SDS dans certains scénarios en nuage ou à la périphérie. | S'il permet une réduction significative des goulets d'étranglement de bout en bout, il favorisera une co-innovation plus poussée en matière de logiciels de stockage et redéfinira le positionnement des disques SSD. |

Le rôle de la DSS passe de celui de "transporteur" à celui de "participant actif".

En résumé, l'impact de l'IA sur l'industrie des SSD en 2025 ne se limite pas à une simple augmentation de la capacité - il s'agit d'un changement systématique touchant les mesures de performance, l'innovation des contrôleurs/firmware, la collaboration de l'écosystème logiciel et le réalignement de la chaîne d'approvisionnement. Les disques SSD passent du statut de produits matériels relativement passifs à celui de composants clés participant activement aux pipelines de traitement des données.

L'essor de l'IA ne se traduit pas seulement par des marchés plus vastes et des opportunités de revenus plus élevées, mais aussi par une profonde introspection de la philosophie de conception des SSD et des modèles de collaboration de l'industrie. Au cours des trois à cinq prochaines années, ceux qui parviendront à innover en matière de contrôleurs, de microprogrammes et de stockage défini par logiciel s'empareront probablement du leadership structurel sur un marché du stockage piloté par l'IA. Dans un environnement technologique et commercial en évolution rapide, la combinaison d'une stratégie prudente mais proactive, d'une coopération entre les écosystèmes et d'un investissement dans les tendances techniques à long terme sera la clé du succès.