El 24 de marzo de 2026, Google Research presentó oficialmente TurboQuant - una innovadora tecnología de compresión de IA que comprime la caché de valores clave (KV Cache) utilizada durante la inferencia de modelos lingüísticos de gran tamaño a 3 bits precisión. Con ello se consigue una Reducción de 6 veces en el uso de memoria y hasta un Velocidad de inferencia 8 veces mayor, todo ello sin pérdida alguna en la precisión del modelo. El anuncio desencadenó una volatilidad inmediata en el mercado mundial de chips de memoria, con la caída en picado de las acciones de Micron Technology y el sufrimiento de grandes empresas como Samsung y SK Hynix, que perdieron colectivamente más de $90.000 millones de valor de mercado. ¿Qué hace que esta tecnología sea tan potente? ¿Supondrá una verdadera revolución en el sector del almacenamiento? ¿Cómo afectará a productos de almacenamiento como Unidades SSD, DDR y HBM ¿evolucionar?

¿Qué es TurboQuant?

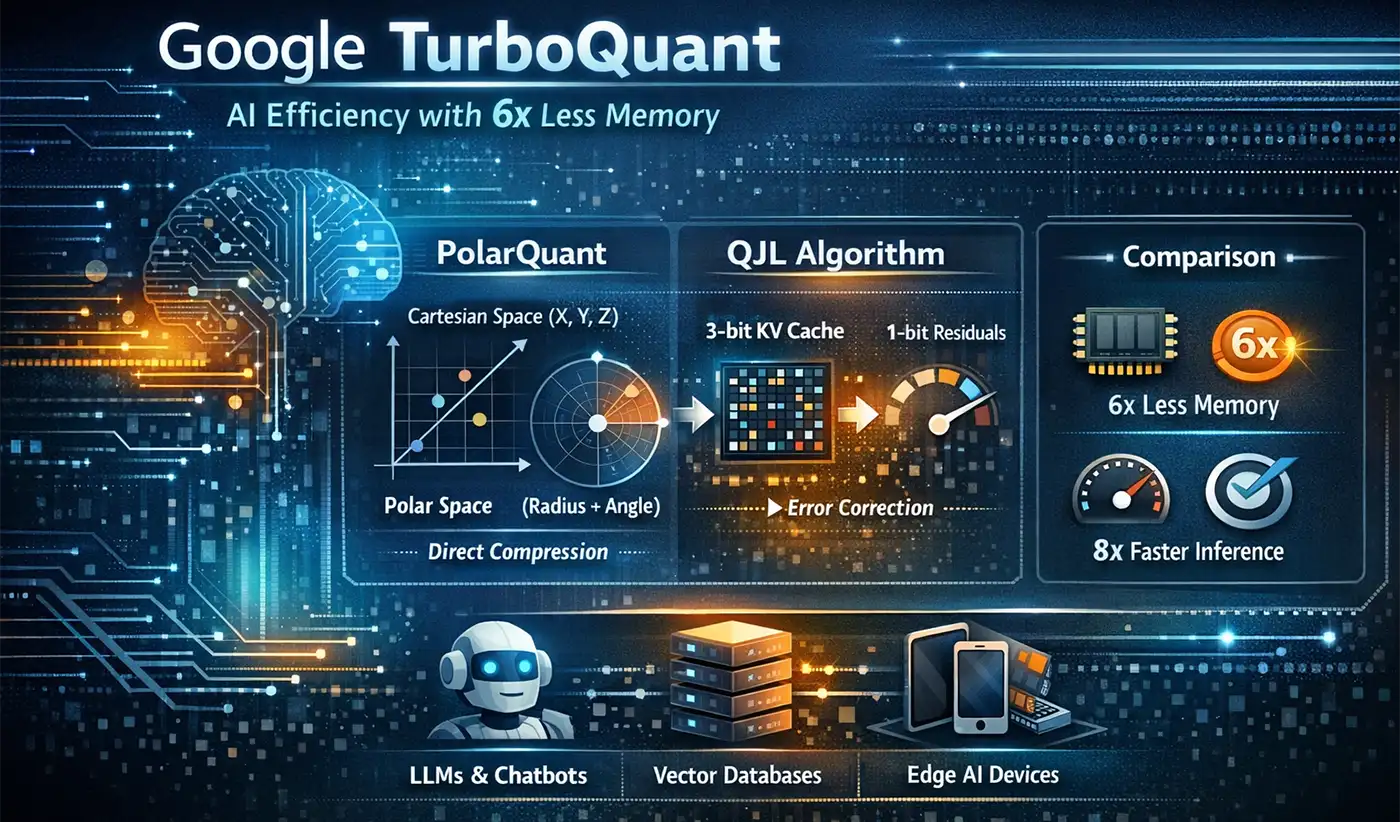

TurboQuant es un algoritmo de cuantificación vectorial en línea sin entrenamiento y sin sesgo de datos desarrollado por Google Research. Está diseñado específicamente para comprimir de forma agresiva el caché de valores clave (caché KV) durante la inferencia de grandes modelos lingüísticos.

La caché KV es una estructura de datos temporal que almacena información contextual durante la inferencia del modelo. Crece continuamente con las conversaciones largas, convirtiéndose en un cuello de botella crítico que limita la capacidad de un modelo para manejar secuencias de texto largas. Los métodos de compresión tradicionales suelen requerir un reentrenamiento del modelo, grandes conjuntos de datos de calibración o almacenamiento adicional para los parámetros de cuantización. El avance de TurboQuant radica en su capacidad para lograr una compresión sin pérdidas de 16/32 bits a 3 bits. sin ajustes del modelo, datos de entrenamiento ni sobrecarga de memoria: una auténtica solución “plug and play”.

Arquitectura de compresión en dos fases

La principal innovación de TurboQuant es su marco de compresión en dos etapas, que utiliza transformaciones matemáticas en lugar de la cuantificación por fuerza bruta para lograr un equilibrio ideal entre eficacia y precisión:

PolarQuant: Es la etapa principal de compresión, que transforma vectores de alta dimensión de coordenadas cartesianas a coordenadas polares. En primer lugar, aplica una rotación aleatoria a los vectores de entrada para uniformizar la distribución de los datos. A continuación, descompone cada vector en radio (que representa la magnitud) y ángulo (que representa la dirección semántica), cuantificando únicamente el ángulo. Este proceso elimina por completo la necesidad de almacenar los parámetros de normalización que requieren los métodos tradicionales.

QJL (transformada cuantizada de Johnson-Lindenstrauss): Es la etapa de corrección residual. Utiliza 1 bit (bit de signo) para aplicar una corrección insesgada a los pequeños errores introducidos durante la etapa PolarQuant, garantizando que la precisión del cálculo de la atención no se vea comprometida. Este paso resuelve el problema de la acumulación de errores que se encuentra en los métodos de compresión tradicionales, haciendo que pérdida de precisión cero teóricamente posible.

Esta combinación de “compresión principal agresiva + corrección residual insesgada” permite a TurboQuant alcanzar un rendimiento a Precisión de 3 bits que iguala o incluso supera las líneas de base de precisión completa, un hecho validado por pruebas estándar como LongBench.

Principales características y ventajas

TurboQuant destaca entre las técnicas de compresión por cuatro ventajas fundamentales:

No requiere formación ni puesta a punto: Puede aplicarse directamente a los modelos existentes (Llama, Mistral, Gemma, Gemini, etc.) sin necesidad de realizar ajustes ni reentrenamientos, lo que permite su despliegue inmediato.

Datos imparciales: Su rendimiento es independiente de la distribución de los datos de entrada, ya que funciona eficazmente con todo tipo de datos de texto, código e imagen sin necesidad de una optimización específica para cada escenario.

Gastos generales cero: No requiere almacenamiento adicional para parámetros de cuantización, factores de normalización, etc., lo que contrasta con los métodos tradicionales.

Teóricamente óptimo: Ofrece garantías de distorsión matemáticamente casi óptimas, proporcionando una previsibilidad de rendimiento fiable para el despliegue a gran escala.

Nube sobre el halo: breve nota sobre la controversia académica

Junto a la conmoción causada en el mercado por TurboQuant, ha surgido una disputa académica. El 27 de marzo, Jianyang Gao, becario postdoctoral de la ETH de Zúrich, alegó públicamente que la metodología central de TurboQuant es muy similar a la de RaBitQ, un algoritmo que publicó en 2024 en SIGMOD. Gao señaló que el documento del equipo de Google evitaba discutir las similitudes metodológicas, menospreciaba los resultados teóricos de RaBitQ como “subóptimos” sin justificación y utilizaba comparaciones experimentales injustas (probando RaBitQ en una CPU de un solo núcleo mientras probaba TurboQuant en una GPU A100).

Según Gao, estos problemas se comunicaron al equipo de Google por correo electrónico antes de la publicación del documento. Aunque el equipo de Google reconoció algunos problemas, al parecer sólo prometió hacer correcciones después de la conferencia y negó las similitudes técnicas. A 31 de marzo, el equipo de RaBitQ había envió un comentario público sobre ICLR OpenReview y presentó una queja formal ante el comité de ética de la conferencia del ICLR. Esta controversia sirve de recordatorio: El valor técnico de TurboQuant aún requiere tiempo para ser plenamente validado, y los problemas de conducta académica que conlleva son igualmente dignos de mención.

Impacto potencial en el sector del almacenamiento

Una mirada racional a la reacción del mercado

La brusca caída de las acciones de chips de almacenamiento tras el anuncio de TurboQuant fue más una reacción exagerada impulsada por el sentimiento del mercado que una evaluación racional. Para entender el verdadero impacto, es crucial definir primero el TurboQuant ámbito de influencia:

Sólo afecta a la inferencia: No tiene ningún impacto en el proceso de entrenamiento de modelos, que es el escenario central de demanda de memorias de gama alta como la HBM.

Sólo comprime la caché KV: Los pesos del modelo, las activaciones y otros datos básicos no se ven afectados. Son los principales consumidores de recursos de almacenamiento.

La paradoja del aumento de la eficiencia: La experiencia histórica sugiere que las mejoras en la eficiencia computacional a menudo conducen a aplicaciones a mayor escala, potencialmente aumentando demanda global de almacenamiento en lugar de disminuirla (paradoja de Jevons).

Impacto potencial en SSD, DDR y HBM

TurboQuant puede tener una memoria DDR de doble impacto. Por un lado, reduce la dependencia de HBM al permitir que la caché KV se almacene de forma más rentable en DDR5/DDR6 en lugar de requerir la costosa HBM. Esto crea nuevas oportunidades para DDR5-8800+ de gran ancho de banda y futura DDR6, posicionándolas como una alternativa rentable a las HBM en los servidores de IA. Por otro lado, TurboQuant acelera la adopción de la tecnología de expansión de memoria CXL. Al agrupar la memoria DDR mediante CXL, los servidores de IA pueden asignar los recursos de memoria de forma más flexible para gestionar tareas de inferencia de distintos tamaños, lo que mejora aún más la eficiencia de utilización de la DDR y la demanda del mercado.

En contra de las preocupaciones del mercado, es probable que TurboQuant suponga un importante avance positivo para las SSD:

Almacenamiento de desbordamiento de contexto largo: Cuando la caché KV supera la capacidad de memoria, las unidades SSD de alta resistencia y baja latencia (como el modo pSLC, NVMe 4.0/5.0) se convierten en la caché secundaria ideal, lo que aumenta significativamente la demanda de rendimiento y capacidad de las unidades SSD de nivel empresarial.

Ampliación de la base de datos de vectores: La creciente adopción de sistemas de generación mejorada de recuperación (RAG), impulsada por TurboQuant, impulsará directamente el crecimiento de las bases de datos vectoriales, que dependen en gran medida de las unidades SSD de alto rendimiento para su almacenamiento subyacente.

Implantación de IA en los bordes: TurboQuant permite ejecutar modelos de inteligencia artificial en dispositivos de consumo, lo que amplía el mercado de las unidades de estado sólido (SSD) para clientes y, en particular, aumenta la demanda de unidades de bajo consumo y alto rendimiento. SSD M.2.

El pánico del mercado a los HBM parece exagerado:

Distinción clara entre formación e inferencia: TurboQuant sólo afecta a la caché KV durante la inferencia. Las demandas de ancho de banda para el entrenamiento de modelos en HBM no disminuyen; HBM sigue siendo un requisito esencial para el entrenamiento de modelos a escala ultra grande.

El peso del modelo no se ve afectado: TurboQuant no comprime las ponderaciones de los modelos, que representan más de 90% del consumo de memoria de la IA. El papel de HBM como medio principal para almacenar estos pesos sigue siendo seguro.

Optimización de la arquitectura híbrida: TurboQuant permite asignar los recursos HBM de forma más eficiente a tareas informáticas críticas, promoviendo el desarrollo de arquitecturas de almacenamiento híbridas que combinan HBM, DDR y SSD, en lugar de una simple sustitución.

Nuevo paradigma potencial para la infraestructura de IA

El valor real de TurboQuant no reside en “eliminar” un tipo específico de almacenamiento, sino en remodelar la arquitectura de almacenamiento por niveles de la infraestructura de IA, impulsando la creación de una jerarquía memoria-almacenamiento más eficiente y económica.

Un nuevo orden para el flujo inteligente de datos

Es probable que las futuras arquitecturas de almacenamiento de servidores de IA presenten una clara pirámide de tres niveles:

Nivel superior - HBM: Se encarga de almacenar los datos computacionales básicos, como los pesos y las activaciones del modelo, y satisface las demandas de ancho de banda intensivo de las tareas de formación e inferencia.

Nivel medio - DDR: Actúa como soporte primario de la caché KV. Al beneficiarse de la eficiencia de compresión de TurboQuant, DDR5/DDR6 se convertirá en la memoria workhorse para escenarios de inferencia.

Nivel inferior - SSD: Gestiona el desbordamiento de contexto largo, las bases de datos vectoriales y los puntos de control de modelo. Las SSD empresariales de baja latencia y alta resistencia encontrarán nuevas oportunidades de crecimiento.

El núcleo de esta arquitectura escalonada es colocación inteligente de datos - Mover dinámicamente los datos entre niveles en función de la frecuencia de acceso, los requisitos de latencia y el coste de almacenamiento para lograr el equilibrio óptimo entre rendimiento y coste.

El auge del almacenamiento definido por software

TurboQuant puede acelerar la adopción de Almacenamiento definido por software (SDS) en IA, sobre todo en los siguientes ámbitos:

Sistemas de gestión de memoria: El software de gestión que puede supervisar el tamaño de la caché KV en tiempo real y decidir de forma inteligente si retener los datos en HBM, DDR o desbordarlos a las SSD se convertirá en un componente estándar de la infraestructura de IA.

Agrupación de memoria CXL: La agrupación de recursos de memoria DDR de varios servidores a través del protocolo CXL proporcionará recursos de memoria elásticamente escalables para clústeres de IA, lo que reducirá aún más los requisitos de capacidad HBM por servidor individual.

Almacenamiento con compresión: Los dispositivos de almacenamiento empezarán a admitir de forma nativa algoritmos de compresión como TurboQuant, lo que permitirá una rápida compresión y descompresión de datos a nivel de hardware para mejorar la eficiencia global del sistema.

El lanzamiento de TurboQuant no es un presagio de catástrofe para la industria del almacenamiento, sino más bien un nuevo punto de partida para una mayor integración entre el almacenamiento y la IA. No se limitará a “eliminar” un determinado tipo de producto de almacenamiento. Por el contrario, gracias a un revolucionario avance en la tecnología de compresión, impulsará la industria del almacenamiento hacia una mayor eficiencia e inteligencia. Esto significa que los futuros servicios de IA serán capaces de manejar textos más largos, proporcionar respuestas más precisas y reducir potencialmente los costes de hardware. La verdadera revolución tecnológica nunca consiste en una simple sustitución, sino en lograr un salto en la eficiencia de la utilización de los recursos a través de la innovación, abriendo así las puertas a aplicaciones más amplias.