2026 年 3 月 24 日,谷歌研究院正式发布了 TurboQuant - 这是一项颠覆性的人工智能压缩技术,可将大型语言模型推理过程中使用的键值缓存(KV Cache)压缩至 3 位 精确。这实现了 内存使用量减少 6 倍 和高达 推理速度提高 8 倍而模型的准确性却丝毫无损。该消息一经公布,立即引发了全球存储芯片市场的波动,美光科技的股价一落千丈,三星和 SK 海力士等主要企业也深受其害,市值合计损失超过 $90 亿美元。是什么让这项技术如此强大?它会真正颠覆存储行业吗?它将如何颠覆存储行业? 固态硬盘、DDR 和 HBM 进化?

什么是 TurboQuant?

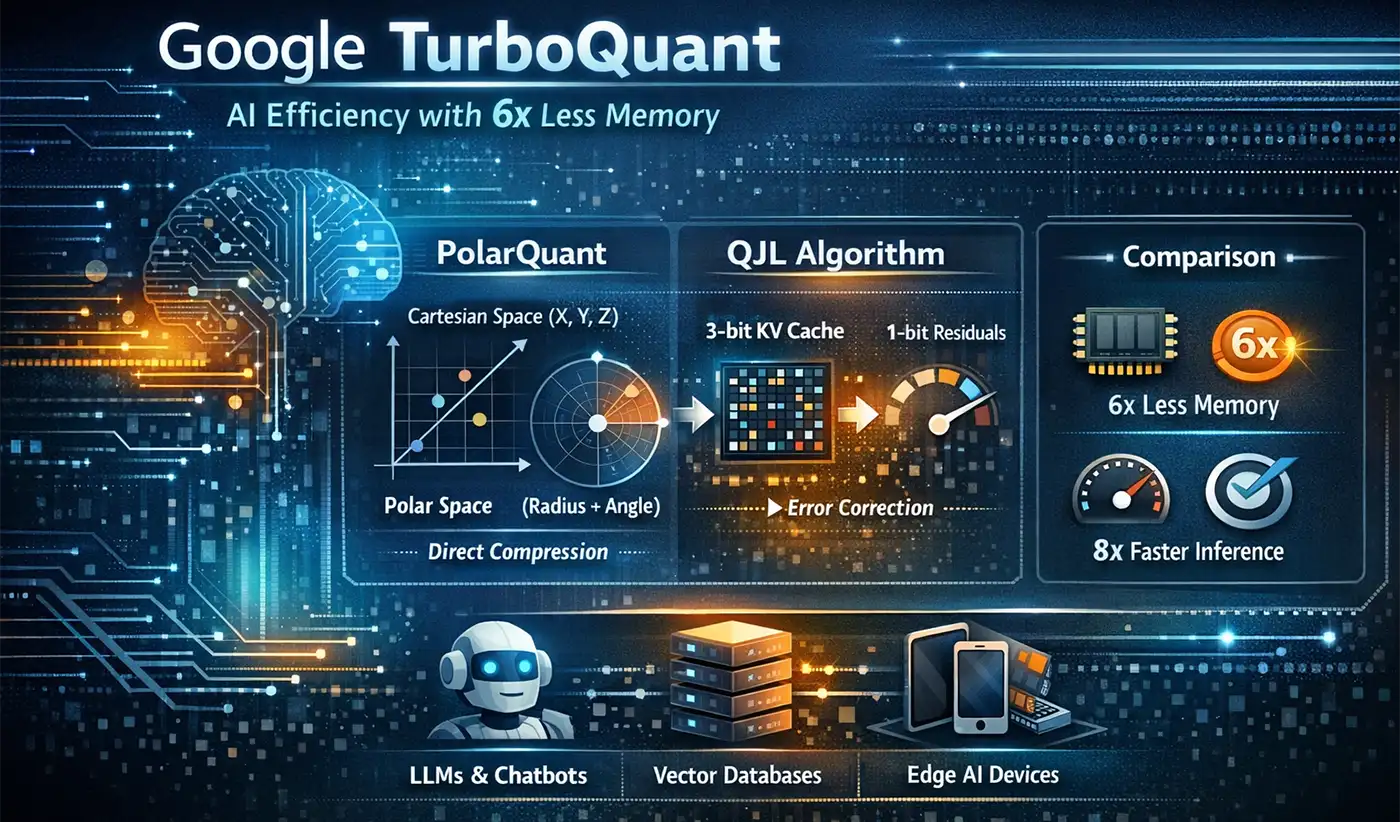

TurboQuant 是一个 免训练、无数据偏差的在线向量量化算法 由 Google Research 开发。它专门设计用于积极压缩 键值缓存(KV 缓存) 在大型语言模型推理过程中

KV 缓存是一种临时数据结构,用于在模型推理过程中存储上下文信息。它随着对话时间的延长而不断增长,成为限制模型处理长文本序列能力的关键瓶颈。传统的压缩方法通常需要对模型进行重新训练、建立大型校准数据集或为量化参数提供额外存储空间。 TurboQuant 的突破在于它能够实现从 16/32 位到 3 位的无损压缩 无需调整模型、训练数据或额外的内存开销,是真正的 "即插即用 "解决方案。

两级压缩架构

TurboQuant 的核心创新在于其 两阶段压缩框架它使用数学变换而不是粗暴的量化,从而在效率和准确性之间达到理想的平衡:

PolarQuant:这是主要的压缩阶段,将高维向量从笛卡尔坐标转换为极坐标。它首先对输入向量进行随机旋转,使数据分布更加均匀。然后,它将每个矢量分解为 半长轴 (代表幅度)和 观点 (代表语义方向),只对角度进行量化。这一过程完全无需存储传统方法所需的归一化参数。

QJL(量化约翰逊-林登斯特劳斯变换):这是残差修正阶段。它使用 1 位 (符号位)对 PolarQuant 阶段引入的微小误差进行无偏校正,确保计算精度不受影响。这一步骤解决了传统压缩方法中的误差累积问题,使 零精度损失 理论上是可能的。

这种 "积极的主压缩+无偏的残差校正 "的组合使 TurboQuant 能够在以下条件下实现性能 3 位精度 这一点在 LongBench 等标准基准测试中得到了验证。

主要特点和优势

TurboQuant 具有四个核心优势,在众多压缩技术中脱颖而出:

无需培训或微调:它可直接应用于现有模型(Llama、Mistral、Gemma、Gemini 等),无需任何调整或重新培训,可立即部署。

数据不偏不倚:它的性能与输入数据的分布无关,可有效处理所有类型的文本、代码和图像数据,无需针对特定场景进行优化。

零间接费用:它无需额外存储量化参数、归一化因子等,与传统方法形成鲜明对比。

理论最佳值:它提供数学上接近最优的失真保证,为大规模部署提供可靠的性能可预测性。

光环上的乌云:学术争论简述

在 TurboQuant 引发市场震动的同时,学术界也出现了一场争论。3 月 27 日,苏黎世联邦理工学院博士后高建阳、 公开声称 TurboQuant 的核心方法与 RaBitQ 高度相似是他于 2024 年在 SIGMOD 上发表的算法。高晓松指出,谷歌团队的论文避而不谈方法上的相似性,毫无理由地将 RaBitQ 的理论结果贬为 "次优",并使用了不公平的实验比较(在单核 CPU 上测试 RaBitQ,而在 A100 GPU 上测试 TurboQuant)。

根据高晓松的说法,这些问题在论文发布前就通过电子邮件告知了谷歌团队。虽然谷歌团队承认了一些问题,但据报道他们只承诺会在会后进行修正,并否认了技术上的相似性。截至 3 月 31 日,RaBitQ 团队已经 在 ICLR OpenReview 上发表了公开评论 并向 ICLR 会议道德委员会提出正式投诉。这次争议提醒了我们:TurboQuant 的技术价值还需要时间来充分验证,而其中涉及的学术行为问题同样值得关注。

对仓储业的潜在影响

理性看待市场反应

TurboQuant 发布公告后,存储芯片类股的大幅下跌更多的是为了吸引投资者。 市场情绪导致的过度反应 而不是合理的评估。要了解真正的影响,首先必须定义 TurboQuant 的 影响范围:

只影响推理:它对模型训练过程没有影响,而这正是 HBM 等高端内存的核心需求场景。

只压缩 KV 缓存:模型权重、激活和其他核心数据不受影响。这些是存储资源的主要消耗者。

提高效率的悖论:历史经验表明,计算效率的提高往往会带来更大规模的应用,有可能 增加 总体存储需求会增加,而不是减少(杰文斯悖论)。

对 SSD、DDR 和 HBM 的潜在影响

与市场的担忧相反,TurboQuant 很可能是固态硬盘的重大积极发展:

长内涵溢出存储:当 KV 缓存超过内存容量时,低延迟、高端固态硬盘(如 pSLC 模式、NVMe 4.0/5.0)将成为理想的二级缓存,从而大幅提升对企业级固态硬盘性能和容量的需求。

矢量数据库扩展:在 TurboQuant 的推动下,越来越多地采用检索增强一代(RAG)系统,这将直接促进矢量数据库的发展,而矢量数据库的底层存储主要依赖于高性能固态硬盘。

边缘人工智能部署:TurboQuant使在消费级设备上运行人工智能模型成为可能,从而扩大了客户端固态硬盘的市场,特别是增加了对低功耗、高性能固态硬盘的需求。 M.2 固态硬盘.

市场对 HBM 的恐慌似乎过头了:

明确区分训练和推理:TurboQuant 只在推理过程中影响 KV 缓存。在 HBM 上训练模型的带宽需求仍然没有减少;HBM 仍然是训练超大规模模型的基本要求。

型号重量存储不受影响: 模型权重占人工智能内存消耗的 90% 以上,TurboQuant 不会对其进行压缩。HBM 作为存储这些权重的主要媒介,其作用仍然是安全的。

混合架构优化:TurboQuant 允许将 HBM 资源更有效地分配给关键计算任务,促进了结合 HBM、DDR 和 SSD 的混合存储架构的发展,而不是简单的替换。

人工智能基础设施的潜在新范式

TurboQuant 的真正价值不在于 "消除 "特定类型的存储,而在于重塑人工智能基础架构的存储分层架构,推动创建更高效、更经济的内存存储层次结构。

智能数据流的新秩序

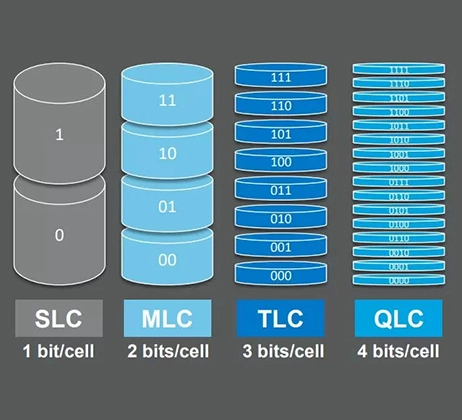

未来的人工智能服务器存储架构可能会呈现出明显的三层金字塔结构:

顶级 - HBM:负责存储模型权重和激活等核心计算数据,满足训练和推理任务的带宽密集型需求。

中间层 - DDR:作为 KV 高速缓存的主要载体。受益于 TurboQuant 的压缩效率,DDR5/DDR6 将成为 工作存储器 用于推理场景。

底层 - 固态硬盘:处理长上下文溢出、向量数据库和模型检查点。低延迟、高端耐用的企业固态硬盘将迎来新的发展机遇。

这种分层架构的核心是 智能数据放置 - 根据访问频率、延迟要求和存储成本在层级之间动态移动数据,以实现性能和成本的最佳平衡。

软件定义存储的崛起

TurboQuant 可加快采用 软件定义存储(SDS) 在人工智能领域,特别是在以下领域:

内存管理系统:能够实时监控 KV 缓存大小并智能决定是否将数据保留在 HBM、DDR 或溢出到 SSD 的管理软件将成为人工智能基础架构的标准组件。

CXL 内存池:通过 CXL 协议汇集多台服务器的 DDR 内存资源,将为人工智能集群提供可弹性扩展的内存资源,进一步降低每台服务器的 HBM 容量要求。

具有压缩意识的存储:存储设备将开始本机支持 TurboQuant 等压缩算法,从而在硬件层面实现快速数据压缩和解压缩,提高整体系统效率。

TurboQuant 的发布并不是存储行业的厄运预兆,而是一个 存储与人工智能深度融合的新起点.它不会简单地 "淘汰 "某一类存储产品。相反,通过压缩技术的革命性突破,它将推动存储行业实现更高的效率和智能化。这意味着未来的人工智能服务将能够处理更长的文本,提供更精确的答案,同时有可能降低硬件成本。真正的技术革命从来不是简单的更新换代,而是通过创新实现资源利用效率的飞跃,从而为更广泛的应用打开大门。